2025-12-13 , 13198 , 2422 , 181

[Src: 腾讯微信/鱼博士, 2025-12-13. ]

信仰的复利与平庸的终结: OpenAI发布 十年 : 回顾与2035超级人工智能预言公开信

引言:回望那个 “疯狂”的起点

2025年12月11日,OpenAI成立十周年。(CEO)Sam Altman发布了一篇名为《Ten Years》(十年)的博文, 并在首页发布了一个相应的视频.

这篇不足两千字的短文,看似是周年庆的公关辞令,实则是对过去十年全球AI产业发展逻辑的最精准注脚,更是一份关于未来十年人类文明走向的 “预言书”。

作为一名长期关注人工智能底层逻辑的研究者看到这封信时,看到的不是硅谷的成功学,而是一部关于 “非共识”如何战胜“平庸共识”的教科书。

站在2025年的当下,当我们已经习惯了GPT-5系列的强大,习惯了Sora 2重构影像产业,我们很容易陷入一种幸存者偏差的视角。

然而,Altman信中最触动神经的,并非是对算力的炫耀,而是那个关于 “15个看起来不合理乐观的极客”的描述。这让我们必须重新审视:为什么是OpenAI?为什么Scaling Laws(缩放定律)成为了物理学一般的铁律?

为什么2035年的超级智能(Superintelligence)预言如此令人战栗又令人平静?

本文将抛开情绪化的赞美,以严谨的行业视角,从科研范式的转移、迭代部署的社会工程学、AGI的时间表、以及超级智能的祛魅四个维度,深度拆解这封公开信背后的深层逻辑。

第一章:非共识的胜利

Altman在信中提到: “我们有着一种深深的信念,虽然我们当时被极度误解。”

(We were extremely misunderstood, we had a deeply held conviction.)

这句话揭示了OpenAI成功的核心秘密:信念资产的复利。

1.1 被误解的 “暴力美学”

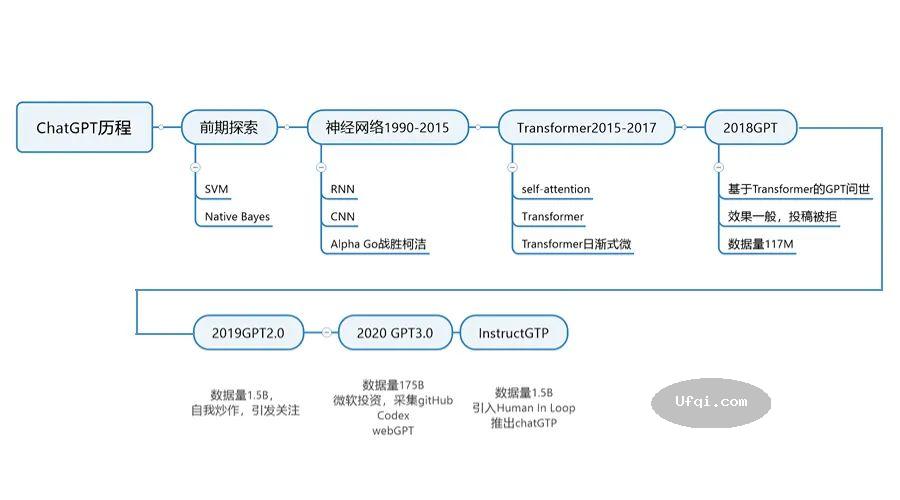

回望2015-2017年,那是深度学习的战国时代。学术界的主流范式依然在追求精巧的网络结构设计、特定任务的SOTA(State of the Art)刷榜。当时的主流观点认为,通向AGI需要精妙的认知架构,而不是单纯的堆砌算力和数据。

OpenAI选择了一条在当时看来极度 “笨重”甚至被讥讽为“炼金术”的道路:Scaling(规模化)。

这种 “不合理的乐观”本质上是对Scaling Laws的一种近乎宗教般的信仰。他们赌定了一个简单的公式:当算力、数据和参数量以特定比例增加时,智能会“涌现”(Emergent)。这在当时缺乏足够的理论支撑,更像是一种直觉。

1.2 OpenAI的 “反内卷”科研文化

Altman提到: “我们建立了一种令人难以置信的发现文化。”

(We built an incredible culture for enabling discovery.)

在中国AI产业的语境下,我们习惯了 “项目制”和“KPI导向”。科研往往被拆解为一个个具体的、可交付的短期目标。然而,OpenAI的早期历史证明了“非目的性探索”的巨大价值。

Dota 2的1v1对战(OpenAI Five的前身)在当时看来是一个游戏,但它验证了强化学习(RL)在大规模环境下的鲁棒性; “情感神经元”(Sentiment Neuron)的发现是一个意外,但它让OpenAI第一次看到了语言模型学习语义而非语法的可能性。

这种科研范式给了我们一个深刻的行业启示:真正的颠覆性创新,往往诞生于对 “长远模糊目标”的坚定投入,而非对“短期清晰指标”的精准计算。当我们在讨论大模型的“落地”和“商业闭环”时,是否也应该留出一部分资源,去赌那些看起来“不合理”的未来?

第二章:迭代部署

信中,Altman着重提到了一个极具争议的战略决策:迭代部署(Iterative Deployment)。

“我们在早期将技术推向世界……这在当时颇具争议,但我认为这是我们做过的最正确的决定之一。”

2.1 走出实验室的 “图灵测试”

在ChatGPT发布之前,Google等巨头虽然拥有LaMDA等强大模型,但受困于 “声誉风险”和“完美主义”,迟迟不愿公测。OpenAI打破了这一行规。

从行业视角看,迭代部署不仅是一种产品策略,更是一种技术演进的必要条件。大模型的发展已经遭遇到 “合成数据”的瓶颈,唯有真实的人类反馈(RLHF,Reinforcement Learning from Human Feedback)才能对齐(Align)模型。

OpenAI实际上是将全人类纳入了其模型的训练循环中。每一个使用ChatGPT的用户,都在为AGI的诞生贡献数据标注。这种 “社会级RLHF”,构建了OpenAI最难以逾越的数据护城河。

2.2 共同进化的社会免疫系统

Altman提到,让社会和技术 “共同进化”(Co-Evolve)。这是一个非常深刻的社会学观点。

如果OpenAI选择在地下实验室秘密研发十年,直接抛出一个具有GPT-5能力的超级智能,人类社会极有可能因为恐慌、法律滞后和伦理冲突而崩溃。通过从GPT-3、3.5到4、4o再到5的渐进式释放,人类社会产生了一种类似 “免疫反应”的适应过程。

我们看到了教育界从封杀ChatGPT到拥抱AI辅助教学;看到了版权法案的艰难博弈与修订;看到了各行各业开始建立 “AI Ready”的工作流。

这种社会适应性(Social Adaptation),是AGI能够软着陆的前提。对于中国的AI从业者而言,这意味着技术研发不能脱离社会土壤,必须在合规、伦理和应用的摩擦中寻找平衡点。

第三章:2035预言

信中最具爆炸性的观点在于对未来的预测: “再过十年,我们几乎可以肯定能建成超级智能(Superintelligence)。”

但Altman紧接着抛出了一个看似矛盾的论断: “未来会感觉很奇怪(weird)……日常生活变化不大。”

3.1 边际成本归零后的世界

为什么超级智能到来,日常生活却 “变化不大”?这涉及到底层经济学逻辑的重构。

当智能的边际成本趋近于零(就像今天的电力一样),它将成为一种隐形的基础设施(Infrastructure)。我们不会因为每天使用电灯而感叹电力的伟大,同样,2035年的人类可能不会因为AI帮我们解决癌症、规划火星移民而感到惊奇,因为那已经是 “出厂设置”。

所谓的 “奇怪”,指的是价值锚点的转移。在工业革命时代,人的价值体现为体力和技能;在信息时代,体现为知识处理能力。而在超级智能时代,当机器在所有智力任务上都超越人类时,人类的价值将回归到“意图”(Intent)和“体验”(Experience)。

3.2 “以人为本”的终极定义

Altman预言: “我们将更加关注人做了什么,而不是机器做了什么。”

这是一个极具哲学意味的行业判断。在AI生成内容(AIGC)泛滥的未来,稀缺的不再是 “内容”,而是“人味”。我们可能会看到一个并非完全由算法统治的世界,反而是一个更加强调“碳基生物共鸣”的世界。

UfqiLong

对于产业界而言,这意味着未来的商业模式将从 “销售智能”转向“销售基于智能的独特体验”。AI是那个能考100分的超级学霸,但决定去哪里旅行、决定创作什么主题电影、决定如何定义幸福的,依然是人类。

3.3 2035年的技术奇点

从技术推演的角度,OpenAI既然敢说出 “2035”这个时间点,意味着他们在内部已经看到了通向Superintelligence的清晰路径。这不仅仅是语言模型,而是涵盖了具身智能(Embodied AI)、自我对齐(Self-Alignment)以及O系列推理模型的全面成熟。

这十年(2025-2035)将是人类历史上最关键的窗口期。我们必须解决由于算力集中带来的地缘政治问题、能源消耗问题,以及最重要的——如何确保超级智能的目标函数与人类福祉一致(Alignment Problem)。

第四章:中国AI产业的镜像反思

读完Altman的信,作为中国AI生态的观察者,我们不能止步于旁观。

4.1 追赶与超越的辩证法

过去十年,中国AI产业在应用层展现了惊人的爆发力,但在底层范式的创新上,我们常常处于 “跟随者”的角色。OpenAI证明了,只有对底层逻辑的极致信仰,才能诞生颠覆性的技术。

这并不意味着我们要盲目复制OpenAI的路径。相反,在算力受限的客观环境下,中国AI产业正在探索一条独特的路径:更强的端侧模型、更垂直的产业落地、以及基于庞大制造业基础的具身智能爆发。

4.2 摒弃 “速胜论”与“崩溃论”

行业内常有两种极端情绪:一种是 “明年就超越OpenAI”的速胜论,一种是“差距越来越大”的崩溃论。Altman的十年总结告诉我们,技术突破是非线性的。GPT-3之前是漫长的寂寞,GPT-3之后是指数级的爆发。

我们需要的是战略定力。无论是学术界的北大、清华,还是产业界的字节、阿里、百度,亦或是像智谱、月之暗面这样的创业公司,都需要在 “商业变现”和“原始创新”之间找到一个更长线的平衡点。

结语:为了那个 “稍显奇怪”的未来

Sam Altman的《十年》是一封写给未来的情书,也是一份写给全人类的挑战书。

他用平实的语言描述了一个宏大的愿景:AGI将造福全人类。这听起来像是一句空洞的口号,但当你看到他们在过去十年是如何一步步将科幻变成现实时,你很难不为此动容。

对于我们——每一个身处AI浪潮中的个体,无论是开发者、创业者、研究员还是政策制定者,这封信都是一次提醒:

我们正在通过编写代码、训练模型、制定规则,亲手塑造那个2035年的世界。

那个世界或许会很 “奇怪”,因为我们将不再是地球上最聪明的物种;但那个世界也充满了希望,因为我们将从繁重的智力劳动中解放出来,去探索星辰大海,去体验纯粹的生命。

正如我在北大课堂上常说的那样:AI不是为了替代人类,而是为了让人类活得更像人类。

OpenAI的十年结束了,属于碳基生命与硅基生命共舞的新纪元,才刚刚开始。

英文原文:

https://openai.com/index/ten-years/

(未完待续, To be contd.)

🔗 连载目录

🤖 智能推荐