Ooops! 抱歉, 未找到精准内容. 请尝试减少或替换相关词语. 如下是相似内容。

-

02-15 21:00...接力出版社特此推出《小王子(图像小说)》。图像小说因为有着文学和艺术的双重价值,正逐步被广大读者认可和喜爱。知名旅日华人作家、本书译者毛丹青从翻译角度介绍了创作背景。“在《小王子(图像小说)》出版之前,几乎所有《小王子》都是直接翻译原著,版本繁杂。同样,日本文学家川端康成作品进入公版领域,国内图书市场进入一片混战。但这... 1

-

05-08 23:20...华为Pura70Ultra的照片成像在一般和复杂的光线环境下都能拥有卓越的表现,领先于竞争机型。同时,算法上的优化配以1英寸传感器,也让它在图像纹理和噪点的处理上较前代Mate60Pro+更进一步。华为Pura70Ultra照片(169分,最高分),是迄今为止拍照模式下表现最好的设备。能为拍摄者提供稳定的曝光、准确妥当... 0

-

05-14 03:30...ChatGPT识别到OpenAI后训练团队负责人巴雷特·佐夫(BarretZoph)脸上的微笑,对他说:“你脸上挂着灿烂的笑容,看起来心情很好。”但GPT-4o在演示过程中也出现一些失误。例如,它在尚未读取到图像时就开始求解方程,还一度把佐夫的面部识别为“木质表面”。英国广播公司(BBC)称,这表明生成式人工智能的“幻... 0

-

05-10 08:30...但大脑记录、理解时间的能力却少有研究。虽然有些研究提出存在客观“体内钟”的假说,但其他研究发现,人们遇到的刺激物的性质对时间的主观感知有着直接影响。美国乔治梅森大学的MartinWiener和同事对170人开展了一系列实验。他们先让参与者以不同的时长观察各种图像,再问他们认为自己看了多久。研究者将这些结果与一个神经网络... 0

-

05-14 03:40...SamAltman所说的“原生多模态”指的是融合了文本、图像和语音功能。他还发帖称,希望尝试使用GPT-4o的开发者将可以获得API,从周一开始就可以使用该新模型构建应用,其价格为GPT-4Turbo的一半,但速度可以达到后者的两倍。此外,GPT-4o在处理英语文本和编程代码方面达到了GPT-4Turbo的性能水平,对... 0

-

05-14 03:40...实时求解方程、做口译、分析图表、读取用户情绪GPT-4之前已经可以分析图像和文本,完成从图像中提取文本、以文本描述图像内容这类任务。GPT-4o则是增加了语音功能。Murati强调了GPT-4o在实时语音和音频功能方面必要的安全性,称OpenAI将继续部署迭代,带来所有的功能。在演示中,OpenAI研究主管MarkCh... 0

-

-

05-11 21:50...则是指对曾经体验过的情绪和情感的记忆,比如童年去游乐园过生日时愉快的记忆、创伤事件留下的悲伤和痛苦的记忆。为何有些东西让我们难以忘记在以往研究中,许多因素都被证明会影响定向遗忘的效果。其中,情绪已被证明具有记忆的增强效应,会通过增强信息的编码和巩固达到增强记忆的效果。简单来说,一本妙趣横生的故事集往往比枯燥无味的流水账... 0

-

05-14 04:20...新开发的“GPT-4o”仍采用作为ChatGPT驱动基础的技术,是自2023年11月发布现行的“GPT-4-turbo”后再次更新。名字里的“o”取自“omni”(意为“全部”)的首字母。新AI支持包括日语在内的50种语言,可识别文字、图像、声音。除实时翻译外,还能通过智能手机摄像头读取人的面部表情,读取图表。新AI对... 0

-

05-08 16:40...团队立刻实行检查制度,每2个小时就派人到塔架上检查是否漏雨。“目前下着小雨,线缆窗口完好无漏雨,温度19.94℃、湿度39.52%,满足要求。”“这个时间雨停了,线缆窗口完好无漏雨,温度19.69℃、湿度40.56%,满足要求。”他们在工作微信群里夜以继日地重复报告着这些细节。所幸,他们担心的事没有发生,精心呵护的仪器... 0

-

05-14 02:20...GPT-4o有着更快的反应速度:它可以在232毫秒的时间内响应音频输入,平均为320毫秒,这与人类在谈话中的反应时间,基本一致。此外,GPT-4o在英语文本和代码上的性能与GPT-4Turbo的性能相匹配,在非英语文本上的性能显着提高,同时API的速度也更快,成本降低了50%,速度是GPT-4-turbo的两倍。与现有... 0

-

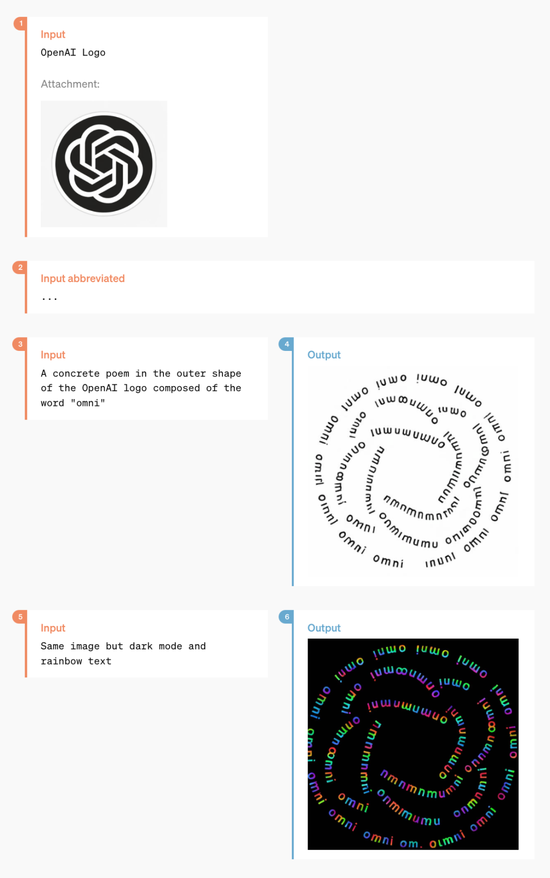

05-15 04:00...GPT-4o能够接受文本、音频和图像的任意组合作为输入,并生成文本、音频和图像的任意组合输出,是兼具了“听觉”、“视觉”的多模态模型。对于这项能力,OpenAI做了17个案例展示,其中包括照片转漫画、3D物体合成、海报创作、角色设计等样本。在角色设计案例里,用户向模型输入角色的相关指令,就可以得到一个机器人角色形象。其... 0

-

05-08 16:40...包括OpenVINOModelZoo、HuggingFace、ONNXModelZoo和PyTorch。这些模型涵盖了本地AI推理的多种类别,包括大语言处理、扩散处理、超分辨率、目标检测、图像分类/分割、计算机视觉等。以下为包括500多个已优化的AI模型的特性和优势:●方便开发和部署。●涵盖20多个AI类别,包括大语言... 0

-

-

05-14 02:20...GPT-4o的响应音频输入的最短时长为232毫秒,平均响应时长320毫秒,几乎与人类相似。没有使用GPT-4o的ChatGPT语音对话功能平均延迟为2.8秒(GPT-3.5)和5.4秒(GPT-4)。GPT-4o不仅通过缩短延迟极大地提升了体验,还在GPT-4的基础上做了很多升级包括:极佳的多模态交互能力,包括语音、视... 0

-

05-15 04:00...“GPT-4o可以综合利用语音、文本和视觉信息进行推理,”穆拉蒂在OpenAI公司总部举行的主题演讲中表示。GPT-4是OpenAI此前的旗舰模型,可以处理由图像和文本混合而成的信息,并能完成诸如从图像中提取文字或描述图像内容等任务,GPT-4o则在此基础上新增了语音处理能力。GPT-4o的运行速度将大大提升,最大亮点... 0

-

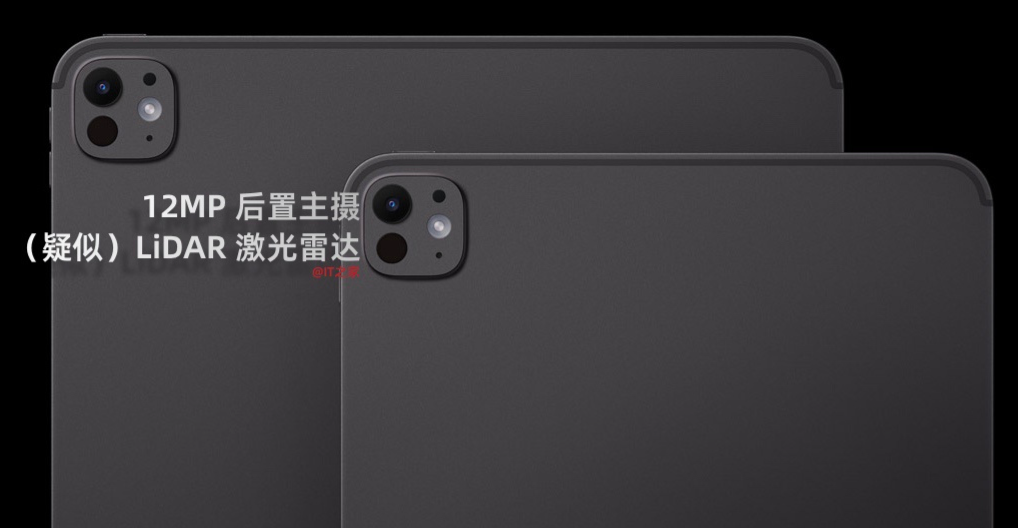

05-08 17:00...2024款iPadPro在摄像头方面有所“降级”,硬件层面从原来的后置双摄(12MP广角主摄+10MP超广角)砍成后置单摄(12MP广角主摄)。不过苹果公司在2024款iPadPro后置摄像头模组外观设计上动了“小心思”,虽然新版本仅提供单摄,但细看相机模组特写才容易分辨。IT之家整理款iPadPro后置摄像头模组官方... 0

-

05-14 02:30...让ChatGPT以一句话的方式回应所有有关此图的问题。最热的月份在几月,Y轴是摄氏度还是华氏度,它都能回答得上来。OpenAI还回应了一些上网友们实时提出的问题。比如实时语音翻译,手机可以拿来当翻译机来回翻译西班牙语和英语。又有人问道,ChatGPT能识别你的表情吗?看起来,GPT-4o已经能够做到实时的视频理解了。接... 0

-

05-15 04:20...还能通过视频聊天的方式与用户进行交互。大会上,谷歌官方演示了这款系统与AR眼镜的结合使用,预示着它在日常生活场景中的广泛应用潜力。尽管目前仍处于原型阶段,但谷歌表示计划在今年晚些时候正式推出。谷歌DeepMind的首席执行官兼联合创始人DemisHassabis亲自展示了Astra模型。这款模型通过智能手机的摄像头捕捉... 0

-

05-08 21:50...利用科技手段,首次对两千多年前战国中山国遗址贝壳画图像进行了成功复原复现,并取得一系列重要研究成果,将贝壳画这种独特艺术形式的历史,至少追溯到战国时期。此项研究成果论文,近日在国际文化遗产保护领域顶级期刊《文化遗产杂志》发表。战国中山国是由白狄族鲜虞部在今河北中南部建立的国家,创造出了独特的文化。中山文化和燕文化、赵文... 0

-

-

05-14 03:00...平均为320毫秒,这与人类在谈话中的反应时间,基本一致。此外,GPT-4o在英语文本和代码上的性能与GPT-4Turbo的性能相匹配,在非英语文本上的性能显着提高,同时API的速度也更快,成本降低了50%,速度是GPT-4-turbo的两倍。与现有模型相比,GPT-4o在视觉和音频理解方面尤其出色。2、全能立体,沟通无... 0

-

05-15 06:00...ChatGPT的免费用户只能使用GPT-3.5。而更新后,用户可以免费使用GPT-4o来进行数据分析、图像分析、互联网搜索、访问应用商店等操作。当然,免费的前提被限制在一定的消息数量上,一旦超过规定数量,免费用户的模型将被切换回GPT-3.5。而付费用户将获得更高的消息数量,至少是免费用户的5倍。同日,OpenAI首席... 0

-

-

-

本页Url:

-

2024-05-15-15:09 GMT . 添加到桌面浏览更方便.

-