... 2024-05-08 14:00 .. 在LiveCodeBench(0901-0401「一个专为实时编码挑战而设计的基准」)上,DeepSeek-V2获得了较高的Pass@1分数。

DeepSeek-V2与不同模型在中文推理、中文语言上的表现:在价格方面,DeepSeek-V2API的定价如下:每百万token输入0.14美元(约1元人民币)、输出0.28美元(约2元人民币,32K上下文),与GPT-4-Turbo定价相比,价格仅为后者的近百分之一。

模型介绍DeepSeek-V2采用Transformer架构,其中每个Transformer块由一个注意力模块和一个前馈网络(FFN)组成。

然而,对于注意力模块和FFN,研究团队设计并采用了创新的架构。

一方面,该研究设计了MLA,利用低秩键值联合压缩来消除推理时键值缓存的瓶颈,从而支持高效推理。

另一方面,对于FFN,该研究采用高性能MoE架构——Dee .. UfqiNews ↓

1

... 10-11 15:05 , 215 , 226 ..

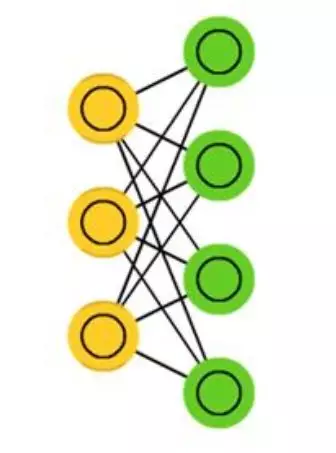

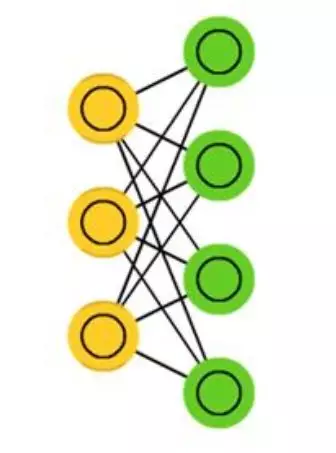

3.2 受限玻尔兹曼机所谓“受限玻尔兹曼机”(RBM)就是对“玻尔兹曼机”(BM)进行简化,使玻尔兹曼机更容易更加简单使用,原本玻尔兹曼机的可见元和隐元之间是全连接的,而且隐元和隐元之间也是全连接的,这样就增加了计算量和计算难度.

“受限玻尔兹曼机”(RBM)同样具有一个可见层,一个隐层,但层内无连接,层与层之间全连接,节点变量仍然取值为0或1,是一个二分图.

也就是将“玻尔兹曼机”(BM)的层内连接去掉,对连接进行限制,就变成了“受限玻尔兹曼机”(RBM),这样就使得计算量大大减小,使用起来也就方便了很多.

... 理解计算:从根号2到AlphaGo -21: 第8季 深度学习发展简史-2 ⟶

... 理解计算:从根号2到AlphaGo -21: 第8季 深度学习发展简史-2 ⟶

3.2 受限玻尔兹曼机所谓“受限玻尔兹曼机”(RBM)就是对“玻尔兹曼机”(BM)进行简化,使玻尔兹曼机更容易更加简单使用,原本玻尔兹曼机的可见元和隐元之间是全连接的,而且隐元和隐元之间也是全连接的,这样就增加了计算量和计算难度.

“受限玻尔兹曼机”(RBM)同样具有一个可见层,一个隐层,但层内无连接,层与层之间全连接,节点变量仍然取值为0或1,是一个二分图.

也就是将“玻尔兹曼机”(BM)的层内连接去掉,对连接进行限制,就变成了“受限玻尔兹曼机”(RBM),这样就使得计算量大大减小,使用起来也就方便了很多.

... 理解计算:从根号2到AlphaGo -21: 第8季 深度学习发展简史-2 ⟶

... 理解计算:从根号2到AlphaGo -21: 第8季 深度学习发展简史-2 ⟶ ... 10-11 15:17 , 217 , 221 ..

5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无能为力了.

这时候,核心问题是需要了解数据的时间序列关系,实际上,RNN最早是由Hopfiled网络启发变种而来,因此有些类似Hopfiled的联想记忆功能.例如,如果我们试图预测一下“天空飞过一只__”这句话最后一个词是什么?利用前面输入的一连串的历史信息:“天 空 飞 过 一 只”,我们就能大致猜出最后一个词可能是某种具有飞行功能的事物,历史(时间信息)对于我们推测未来,是极有帮助的,不可轻易抛弃.

而RNN的核心诉求之一,就是能将以往的信息连接到当前任务之中.

RNN模型有比较多的变种,一种主流的RNN模型结构如 ... 理解计算:从根号2到AlphaGo -23: 第8季 深度学习发展简史-4 ⟶

5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无能为力了.

这时候,核心问题是需要了解数据的时间序列关系,实际上,RNN最早是由Hopfiled网络启发变种而来,因此有些类似Hopfiled的联想记忆功能.例如,如果我们试图预测一下“天空飞过一只__”这句话最后一个词是什么?利用前面输入的一连串的历史信息:“天 空 飞 过 一 只”,我们就能大致猜出最后一个词可能是某种具有飞行功能的事物,历史(时间信息)对于我们推测未来,是极有帮助的,不可轻易抛弃.

而RNN的核心诉求之一,就是能将以往的信息连接到当前任务之中.

RNN模型有比较多的变种,一种主流的RNN模型结构如 ... 理解计算:从根号2到AlphaGo -23: 第8季 深度学习发展简史-4 ⟶

本页Url

🤖 智能推荐