-

04-23 01:10...Llama38B模型在MMLU、GPQA、HumanEval等多项基准上均胜过Gemma7B和Mistral7BInstruct。在Meta公布的AI基准测试中,Llama370B的表现甚至超越了谷歌的GeminiPro1.5以及Anthropic的Claude3Sonnet。Meta还披露了Llama34000亿参数... 0

-

04-23 00:40...即在保持基于注意力的Transformer结构不变的情况下减少基础语言模型的参数或视觉token的数量。本文提出了一个不同的视角:直接采用状态空间模型(SSM)作为骨干网络,得到了一种线性计算复杂度的MLLM。此外,本文还探索和研究了各种模态融合方案,以创建一个有效的多模态Mamba。具体来说,本文采用Mamba语言模... 0

-

04-23 00:40...无需担心繁琐的训练和部署流程。Llama3作为Meta推出的新一代开源大语言模型,其80亿及700亿参数版本均展现出了强大的性能。然而,对于特定语言或垂直领域的需求,通常需要对这些开源模型进行进一步的训练或微调。这一过程在过去可能较为复杂,但现在,阿里云百炼平台提供的一键式解决方案让这一切变得简单。阿里云百炼平台不仅提... 0

-

04-22 05:30...新华社记者许畅摄一条新能源汽车轮胎与传统汽车轮胎有什么不同?在著名轮胎制造商德国大陆马牌轮胎设在安徽省合肥市的生产基地,负责人耐心地向记者解释,相比传统汽车,新能源汽车对轮胎噪音和抓地力要求更高,在轮胎滚阻、耐磨性等指标上都提出新要求。大陆马牌在华研发团队开发了针对中国市场实际需求的新能源汽车专款轮胎,并同步到大陆马牌... 0

-

04-22 05:30...生成了一维的3Di结构序列(使用了Foldseek的结构词表,每种3Ditoken代表不同的局部结构),这样的结构序列与氨基酸序列是等长的。因此本文使用了一种简单而有效的结构嵌入方式:将结构词表和氨基酸词表计算笛卡尔积(即两两组合),形成新的结构感知词表。这样对于蛋白质的每个位点,其氨基酸类型和对应的局部结构都能组合成... 0

-

04-22 04:40...、Databricks、GoogleCloud、HuggingFace、Kaggle、IBMWatsonX、MicrosoftAzure等主要云提供商、模型API提供商平台上线,Llama还得到AMD、AWS、戴尔、英特尔、NVIDIA和高通提供的硬件平台的支持。在官网上,Meta还放出了Llama3两个版本与谷歌Ge... 0

-

-

04-20 22:10...Open-Sora计划已于近期在GitHub上公开,它核心技术框架包括视频编解码模块、DiffusionTransformer模型和条件输入三大模块。与“财大气粗”的OpenAI不同,在资源有限的情况下,Open-Sora计划采用了计算更友好的2D+1DDiffusionTransformer,同步还在推进除了文本控制... 0

-

04-20 07:00...面向所有人开放,无论是开发者、研究人员还是对AI技术好奇的小伙伴,都可以自由地探索、创造和实验。2.Llama3的训练是基于超过15万亿token的数据集,是Llama2数据集的7倍还多,为模型提供了更丰富的信息基础。3.支持8K长文本,配备了改进的tokenizer,词汇量高达128K,提升了模型的性能表现。4.新增... 0

-

04-19 21:00...就那些……或Facebook或Instagram或那些不同的服务而言。也许是网站,我想是我们正在推出的Meta.ai。然而,我认为在过去的18个月里,有一个令人惊讶的发现,那就是编码在许多领域都显得至关重要,而不仅仅局限于编码本身,因此,即使人们并未直接向模型提出编码问题,对模型进行编码训练也能帮助它们更严谨地回答问题... 0

-

04-17 01:00...他大约一半的客户从GPT-4或Anthropic的Claude模型中获取数据,并用它来改进自己的模型。许多公司也从ShareGPT获得此类数据,ShareGPT是一个开发人员分享使用OpenAI模型生成答案的网站。小型开发商的模型通常基于MetaPlatforms或MistralAI免费提供的流行开源模型,但通过融合O... 0

-

04-09 00:10...当下对其GPT-4技术猜测的主流观点也认为,他们一定采用了MoE架构。MoE不太省心,但确实可以降本MoE架构的中文名称是混合专家架构,是神经网络的一种架构模式。它将神经网络拆分成多个专家子网络,面对一次输入,既可以指定某一位“专家”来回答,也可以要求多位“专家”回答,甚至全部参与回答,最终依据权重综合给出结果。这使得... 0

-

04-05 22:30...沈阳告诉《新浪蜂鸟》,中国大部分AIGC领域的算法主要还是靠美国的一些公司开源。“美国公司开源算法了之后,我们就能拉齐水平,但Sora并不开源,所以领先的部分我们很难在短期内知道,从这个角度上来说,中美之间的技术差距是动态的,例如OpenAI发布新版本差距就拉大了,在发布前,我们又能追的稍微近一点。”浙江大学计算机博士... 0

-

-

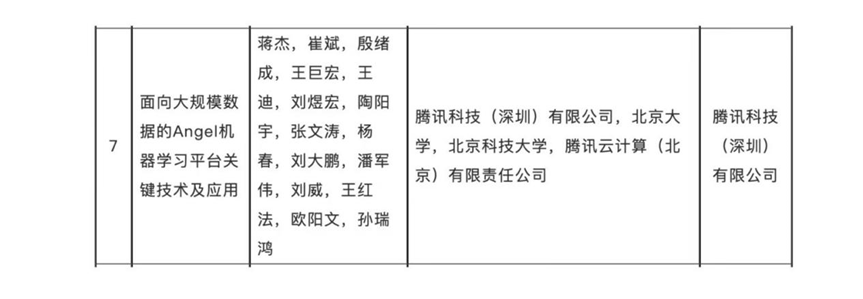

04-04 01:00...研发过程中累计授权发明专利74项,发布国家/行业标准9项,发表高水平论文56篇,其中3篇获学术领域最佳论文奖。由多名院士等权威专家组成的鉴定委员会认为,腾讯Angel机器学习平台技术复杂度高、研制难度大、创新性强,应用前景广阔,整体技术达到国际先进水平,其中面向all-to-all通信的高效缓存调度与管理技术、自适应预... 0

-

03-26 15:50...xAI将开源聊天机器人Grok”3月11日晚特斯拉创始人埃隆·马斯克在其旗下的社交平台X上言简意赅地发布了上述消息今天凌晨开源版大模型Grok终于来了xAI正式发布3140亿参数混合专家模型Grok-1的基本模型权重和网络架构而3140亿的参数也让Grok-1成为迄今参数量最大的开源LLM官方显示的模型细节包括①基础模... 0

-

03-24 09:00...其运行功率仅20瓦,而千亿参数模型的推理功率是它的百倍以上,处理的信息更单一。其中,MoE(MixtureofExperts)值得关注,经过良好训练的MoE可取得比同等激活参数量的稠密模型更好的性能。业界也在探索Mamba模型等,以低复杂度的注意力架构更高效地处理上下文。在训练数据方面,从追求数量到寻求规模化构建高质量... 1

-

03-17 21:00...论文题目:ASurveyonKnowledgeDistillationofLargeLanguageModels论文链接:项目链接:综述架构大语言模型知识蒸馏的整体框架总结如下图所示:首先,根据大语言模型知识蒸馏的流程,该综述将知识蒸馏分解为了两个步骤:1.知识获取(KnowledgeElicitation):即如何从... 0

-

03-12 02:20...作为MistralAI商用系列中的旗舰模型,MistralLarge与GPT-4一样并未开源。用户可通过三种方式访问与使用Mistral模型:其中,在欧洲的MistralAl基础设施上安全托管的LaPlateforme是开发者访问MistralAl所有模型的首选方式,开发者可通过点击创建自己的应用程序和服务;Mistr... 0

-

02-28 23:30...Gemma词汇量达到256000个单词,相比之下,Llama的词汇量为32000个单词;其次是训练数据集达6万亿token,作为对比,Llama仅接受了其中三分之一的训练。在架构方面,Raschka列举了Gemma与LLama27B和OLMo7B的架构概览。在模型大小上,Raschka表示Gemma2B有多查询注意力,... 0

-

-

02-28 23:30...这就要转向了吗?MistralLarge目前已经能在MistralAI自有平台LaPlateforme和微软Azure上使用。除了MistralLarge之外,MistralAI还发布了新模型MistralSmall,针对延迟和成本进行了优化。MistralSmall的性能优于Mixtral8x7B,并且推理延迟得到了... 0

-

02-25 17:40...且它们已提供了退出的选择。这一争端引发了公众对于大模型训练数据版权的关注。我国法律如何看待大模型训练数据的版权情况,如何对大模型使用数据进行有效治理?2月初,记者采访了相关专家。训练数据面临较高法律风险大模型的训练数据究竟是哪儿来的?去年,OpenAI首席执行官萨姆奥尔特曼接受采访时表示,他们花费了大量的精力整合不同来... 0

-

02-21 19:00...以及发布史上性能和功能最强大的GeminiUltra1.0模型等。然而,2月中旬Gemini1.5发布的同时,OpenAI全新视频生成模型Sora突然亮相,一经面世瞬间成为顶流,话题热度只增不减。所有人都在讨论Sora为行业带来的改变,但这让谷歌在AI领域的努力一下子“黯然失色”。仅过了不到半个月,如今,谷歌卷土重来,... 0

-

02-17 11:50...这一争端引发了公众对于大模型训练数据版权的关注。我国法律如何看待大模型训练数据的版权情况,如何对大模型使用数据进行有效治理?2月初,记者采访了相关专家。训练数据面临较高法律风险大模型的训练数据究竟是哪儿来的?去年,OpenAI首席执行官萨姆奥尔特曼接受采访时表示,他们花费了大量的精力整合不同来源的数据,包括开源信息数据... 0

-

-

-

本页Url:

-

2024-04-28-17:22 GMT . 添加到桌面浏览更方便.

-