... 2024-01-30 19:20 .. 更广泛的风险情绪应有助于创造短期交易机会。

预计美国12月JOLTs职位空缺数据将于北京时间周二23:00公布,值为875万,前值为879万。

JOLTS报告是美国财长耶伦在担任美联储主席时高度重视的劳动力市场指标之一,也是美联储关注的重点数据。

同时,美国1月谘商会消费者信心指数将于周二23:00公布,预计值为115.0,前值为110.7。

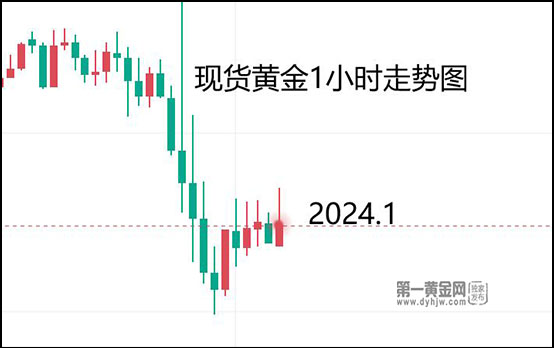

从技术角度看,黄金多头可能仍在等待金价持续突破2040-2042美元/盎司阻力区域,然后进行新一轮押注,为更进一步上涨做准备。

鉴于日线图上的振荡指标刚刚开始进入积极区域,一旦突破上述阻力区域,金价可能攀升至2077美元/盎司,随后瞄准2100美元/盎司整数关口。

下行方面,周一低点(约2020-2019美元/盎司附近)目前似乎在2012-2010美元/盎司区域和2000美元/盎司心理关口之前的短期下行空间得到保护。

若金价跌破20 .. UfqiNews ↓

2

... 12-26 03:15 , 1528 , 134 ..

三、单元测试 1. 【强制】好的单元测试必须遵守AIR原则.

说明:单元测试在线上运行时,感觉像空气(AIR)一样感觉不到,但在测试质量的保障上,却是非常关键的.

好的单元测试宏观上来说,具有自动化、独立性、可重复执行的特点.

⚫ A:Automatic(自动化) ⚫ I:Independent(独立性) ⚫ R:Repeatable(可重复) 2. 【强制】单元测试应该是全自动执行的,并且非交互式的.

测试用例通常是被定期执行的,执行过程必须完全自动化才有意义.

输出结果需要人工检查的测试不是一个好的单元测试.

单元测试中不准使用System.out来进行人肉验证,必须使用assert来验证.

3. 【强制】保持单元测试的独立性.

为了保证单元测试稳定可靠且便于维护,单元测试用例之间 ... Java開發手冊-阿里巴巴-嵩山版-15:单元测试 ⟶

三、单元测试 1. 【强制】好的单元测试必须遵守AIR原则.

说明:单元测试在线上运行时,感觉像空气(AIR)一样感觉不到,但在测试质量的保障上,却是非常关键的.

好的单元测试宏观上来说,具有自动化、独立性、可重复执行的特点.

⚫ A:Automatic(自动化) ⚫ I:Independent(独立性) ⚫ R:Repeatable(可重复) 2. 【强制】单元测试应该是全自动执行的,并且非交互式的.

测试用例通常是被定期执行的,执行过程必须完全自动化才有意义.

输出结果需要人工检查的测试不是一个好的单元测试.

单元测试中不准使用System.out来进行人肉验证,必须使用assert来验证.

3. 【强制】保持单元测试的独立性.

为了保证单元测试稳定可靠且便于维护,单元测试用例之间 ... Java開發手冊-阿里巴巴-嵩山版-15:单元测试 ⟶

... 02-08 06:18 , 7436 , 111 ..

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10

未来之路:LLM研究趋势及值得研究的重点方向

这里列出一些我个人认为比较重要的LLM研究领域,或值得深入探索的研究方向.

探索LLM模型的规模天花板

尽管继续推大LLM模型的规模,这事看似没有技术含量,但是其实这个事情异常重要.

我个人判断,自从Bert出现以来,到GPT 3,再到ChatGPT,大概率这些给人印象深刻的关键技术突破,核心贡献都来自于LLM模型规模的增长,而非某项具体技术.

说不定,揭开AGI真正的钥匙就是:超大规模及足够多样性的数据、超大规模的模型,以及充分的训练过程.

再者,做超大规模的LLM模型,对技术团队的工程实现能力要求是非常高的,也不能认为这事情缺乏技术含量.

那么继续推大LLM模型规模,有什么研究意义呢?我觉得有两方面的价值.

首先,如上所述,我们已知,对于知识密集型的任务,随着模型规模越大,各种任务的效果会越来越好;

而对很多推理类型的有难度的任务,加上CoT Prompting后,其效果也呈现出遵循Scaling law的趋向.

那么,很自然的一个问题就是:对于这些任务,LLM的规模效应,能将这些任务解决到何种程度?这是包括我在内,很多人关心的问题.

其次,考虑到LLM具备的神奇的 “涌现能力”,如果我们继续增加模型规模,它会解锁哪些让我们意想不到的新能力呢?这也是很有意思的问题.

考虑到以上两点,我们仍然需要不断增大模型规模,看看模型规模对解决各类任务的天花板在哪里.

当然,这种事情也就只能说说,对99.99%的从业者来说,是没有机会和能力做这个事情的.

要做这个事情,对研究机构的财力及投入意愿、工程能力、技术热情,都有极高的要求,缺一不可.

能做这事情的机构,粗估下来,国 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10 ⟶

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10

未来之路:LLM研究趋势及值得研究的重点方向

这里列出一些我个人认为比较重要的LLM研究领域,或值得深入探索的研究方向.

探索LLM模型的规模天花板

尽管继续推大LLM模型的规模,这事看似没有技术含量,但是其实这个事情异常重要.

我个人判断,自从Bert出现以来,到GPT 3,再到ChatGPT,大概率这些给人印象深刻的关键技术突破,核心贡献都来自于LLM模型规模的增长,而非某项具体技术.

说不定,揭开AGI真正的钥匙就是:超大规模及足够多样性的数据、超大规模的模型,以及充分的训练过程.

再者,做超大规模的LLM模型,对技术团队的工程实现能力要求是非常高的,也不能认为这事情缺乏技术含量.

那么继续推大LLM模型规模,有什么研究意义呢?我觉得有两方面的价值.

首先,如上所述,我们已知,对于知识密集型的任务,随着模型规模越大,各种任务的效果会越来越好;

而对很多推理类型的有难度的任务,加上CoT Prompting后,其效果也呈现出遵循Scaling law的趋向.

那么,很自然的一个问题就是:对于这些任务,LLM的规模效应,能将这些任务解决到何种程度?这是包括我在内,很多人关心的问题.

其次,考虑到LLM具备的神奇的 “涌现能力”,如果我们继续增加模型规模,它会解锁哪些让我们意想不到的新能力呢?这也是很有意思的问题.

考虑到以上两点,我们仍然需要不断增大模型规模,看看模型规模对解决各类任务的天花板在哪里.

当然,这种事情也就只能说说,对99.99%的从业者来说,是没有机会和能力做这个事情的.

要做这个事情,对研究机构的财力及投入意愿、工程能力、技术热情,都有极高的要求,缺一不可.

能做这事情的机构,粗估下来,国 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10 ⟶

本页Url

🤖 智能推荐