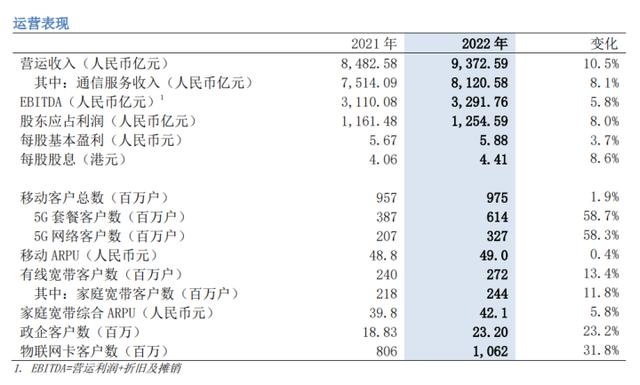

... 2023-03-28 08:30 .. 移动ARPU稳健增长,为人民币49.0元,同比增长0.4%。

家庭市场:价值引领快速增长着力拓展“全千兆+云生活”价值空间,积极推进宽带、电视、智慧家庭“三领先”工程,加快推动家庭业务向HDICT(家庭信息化解决方案)转型升级。

坚持千兆引领宽带领先,加快千兆宽带规模拓展、应用培育和服务升级,打造高品质千兆口碑;坚持内容驱动电视领先,推动传统电视向智能电视、投影仪等泛屏终端升级,做强做优“宽带电视+数字院线+垂直内容”的家庭信息服务入口;坚持创新推动智家领先,融合拓展大屏点播、智能组网、家庭安防等高成长产品,围绕数字乡村、智慧社区、全屋智能、智能车空间等新应用场景,创新构建HDICT标准化运营体系。

2022年,家庭市场保持快速增长,收入达到人民币1,166亿元,同比增长16.0%;家庭宽带客户达到2.44亿户,净增2,578万户,持续保持行业领先。

千兆宽带普及加 .. UfqiNews ↓

2

... 02-01 03:13 , 7330 , 155 ..

[编按: 转载于 网易网/ 经济日报 , 2023-02-01. 原作者 (经济日报记者 陈果静).

] 人们为什么又爱存钱了? (2023年)1月29日,消费者在中免集团海口日月广场免税店选购化妆品.

今年春节假期,海南离岛免税消费持续火爆.

(新华社发)近期“超额储蓄”引发较多讨论.

超额储蓄,简单来说,就是相对于往年,2022年的居民新增存款明显较多.

中国人民银行公布的数据显示,2022年人民币存款增加26.26万亿元,同比多增6.59万亿元.

其中,住户存款增加17.84万亿元,这与2021年全年的水平相比,多增7.94万亿元.

人们为什么又爱存钱了?业内专家认为,居民存款大幅度增长、储蓄意愿增强的原因是多方面的,既有短期影响也有长期因素.

应正视这一现象,并采取措施合理引导居民预期,提升居民消费和投资的意愿和能力,将居民存款转化为长期资金,更好地促进实体经济发展.

居民不爱贷款爱存钱 2022年,住户存款,也就是居民存款增加17.84万亿元.

较2021年多增7.94万亿元,较2020年多增6.54万亿元,较2019年多增8.14万亿元,创有统计以来的新高.

伴随存款的增长,居民贷款却在收缩.

2022年住户贷款,也就是居民贷款增加3.83万亿元,同比少增4.09万亿元.

其中,短期贷款增加1.08万亿元、中长期贷款增加2.75万亿元,同比分别少增7600亿元、3.33万亿元,住户中长期贷款增量为2015年以来最低.

央行2022年四季度城镇储户问卷调查结果也表明,倾向于“更多储蓄”的居民占61.8%,比上季增加3.7个百分点;倾向于“更多投资”的居民占15.5%,比上季减少3.7个百分点.

招联金融首席研究员董希淼认为,这反映出受多重因素影响,居民就业、收入不够稳定,预防性储蓄动机上升,日常消费需求下降,住房消费和投资意 ... 人们为什么又爱存钱了? ⟶

[编按: 转载于 网易网/ 经济日报 , 2023-02-01. 原作者 (经济日报记者 陈果静).

] 人们为什么又爱存钱了? (2023年)1月29日,消费者在中免集团海口日月广场免税店选购化妆品.

今年春节假期,海南离岛免税消费持续火爆.

(新华社发)近期“超额储蓄”引发较多讨论.

超额储蓄,简单来说,就是相对于往年,2022年的居民新增存款明显较多.

中国人民银行公布的数据显示,2022年人民币存款增加26.26万亿元,同比多增6.59万亿元.

其中,住户存款增加17.84万亿元,这与2021年全年的水平相比,多增7.94万亿元.

人们为什么又爱存钱了?业内专家认为,居民存款大幅度增长、储蓄意愿增强的原因是多方面的,既有短期影响也有长期因素.

应正视这一现象,并采取措施合理引导居民预期,提升居民消费和投资的意愿和能力,将居民存款转化为长期资金,更好地促进实体经济发展.

居民不爱贷款爱存钱 2022年,住户存款,也就是居民存款增加17.84万亿元.

较2021年多增7.94万亿元,较2020年多增6.54万亿元,较2019年多增8.14万亿元,创有统计以来的新高.

伴随存款的增长,居民贷款却在收缩.

2022年住户贷款,也就是居民贷款增加3.83万亿元,同比少增4.09万亿元.

其中,短期贷款增加1.08万亿元、中长期贷款增加2.75万亿元,同比分别少增7600亿元、3.33万亿元,住户中长期贷款增量为2015年以来最低.

央行2022年四季度城镇储户问卷调查结果也表明,倾向于“更多储蓄”的居民占61.8%,比上季增加3.7个百分点;倾向于“更多投资”的居民占15.5%,比上季减少3.7个百分点.

招联金融首席研究员董希淼认为,这反映出受多重因素影响,居民就业、收入不够稳定,预防性储蓄动机上升,日常消费需求下降,住房消费和投资意 ... 人们为什么又爱存钱了? ⟶

... 02-08 06:12 , 7432 , 127 ..

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-6

规模效应:当LLM越来越大时会发生什么

我们知道,近年来,LLM模型规模在快速增长,目前效果最好的LLM模型,其参数规模大都超过了千亿(100B)参数规模.

比如,OpenAI的GPT 3的规模为175B,Google的LaMDA规模为137B,PaLM的规模为540B,DeepMind的Gogher规模为280B等,不一而足.

国内也有中文巨型模型,比如清华&智谱GLM规模130B,华为 “盘古”规模200B,百度“文心”规模260B,浪潮“源1.0”规模245B.

那么,一个很自然的问题就是:随着LLM模型规模不断增长,会发生些什么呢?

预训练模型的应用往往是两阶段的:预训练阶段,及具体场景应用阶段.

在预训练阶段,其优化目标是交叉熵,对GPT这种自回归语言模型来说,也就是看LLM是否正确预测到了下一个单词;而场景应用阶段,一般要看具体场景的评价指标.

一般我们的直觉是:如果LLM模型在预训练阶段的指标越好,自然它解决下游任务的能力就越强.

然而,事实并非完全如此.

现有研究已证明,预训练阶段的优化指标确实和下游任务表现出正相关关系,但是并非完全正相关.

也就是说,只看预训练阶段的指标,来判断一个LLM模型是否够好,这是不够的.

基于此,我们分头来看在这两个不同阶段,随着LLM模型增大,有什么影响.

首先,我们先看在预训练阶段,随着模型规模逐步增大,会发生什么.

OpenAI在 “Scaling Laws for Neural Language Models”中专门研究了这个问题,并提出LLM模型所遵循的“伸缩法则”(scaling law).

如上图所示,这个研究证明:当我们独立增加训练数据量、模型参数规模或者延长模型训练时间(比如从1个Epoch ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-6 ⟶

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-6

规模效应:当LLM越来越大时会发生什么

我们知道,近年来,LLM模型规模在快速增长,目前效果最好的LLM模型,其参数规模大都超过了千亿(100B)参数规模.

比如,OpenAI的GPT 3的规模为175B,Google的LaMDA规模为137B,PaLM的规模为540B,DeepMind的Gogher规模为280B等,不一而足.

国内也有中文巨型模型,比如清华&智谱GLM规模130B,华为 “盘古”规模200B,百度“文心”规模260B,浪潮“源1.0”规模245B.

那么,一个很自然的问题就是:随着LLM模型规模不断增长,会发生些什么呢?

预训练模型的应用往往是两阶段的:预训练阶段,及具体场景应用阶段.

在预训练阶段,其优化目标是交叉熵,对GPT这种自回归语言模型来说,也就是看LLM是否正确预测到了下一个单词;而场景应用阶段,一般要看具体场景的评价指标.

一般我们的直觉是:如果LLM模型在预训练阶段的指标越好,自然它解决下游任务的能力就越强.

然而,事实并非完全如此.

现有研究已证明,预训练阶段的优化指标确实和下游任务表现出正相关关系,但是并非完全正相关.

也就是说,只看预训练阶段的指标,来判断一个LLM模型是否够好,这是不够的.

基于此,我们分头来看在这两个不同阶段,随着LLM模型增大,有什么影响.

首先,我们先看在预训练阶段,随着模型规模逐步增大,会发生什么.

OpenAI在 “Scaling Laws for Neural Language Models”中专门研究了这个问题,并提出LLM模型所遵循的“伸缩法则”(scaling law).

如上图所示,这个研究证明:当我们独立增加训练数据量、模型参数规模或者延长模型训练时间(比如从1个Epoch ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-6 ⟶

本页Url

🤖 智能推荐