Ooops, Data read error for 3382593, Try new one ( 读取异常, 请尝试搜索关键词 ) ....

... 2024-04-16 03:50 .. 促进二手车放心便利交易,培育壮大二手车经营主体,推动汽车流通消费创新发展。

二是推动家电以旧换新。

发挥财税政策引导作用,鼓励出台惠民举措,完善废旧家电回收网络,加大多元化主体培育力度,强化家电标准引领与支撑,推动全面提升售后服务水平,发展二手商品流通。

三是推动家装厨卫“焕新”。

加大惠民支持力度,提升便民服务水平,培育家居新增长点,优化家居市场环境。

《行动方案》提出,通过加大政策引导支持力度,力争到2025年,实现国三及以下排放标准乘用车加快淘汰,高效节能家电市场占有率进一步提升;报废汽车回收量较2023年增长50%,废旧家电回收量较2023年增长15%;到2027年,报废汽车回收量较2023年增加一倍,二手车交易量较2023年增长45%,废旧家电回收量较2023年增长30%。

为了达到上述目标,《行动方案》作出一系列部署。

比如,在强化资金管理和要素保障方面,《行 .. UfqiNews ↓ 0

...

02-08 06:09 , 7430 , 160 ..

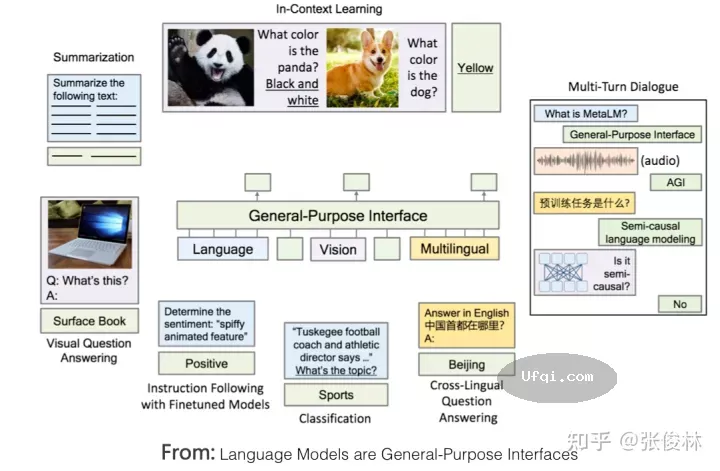

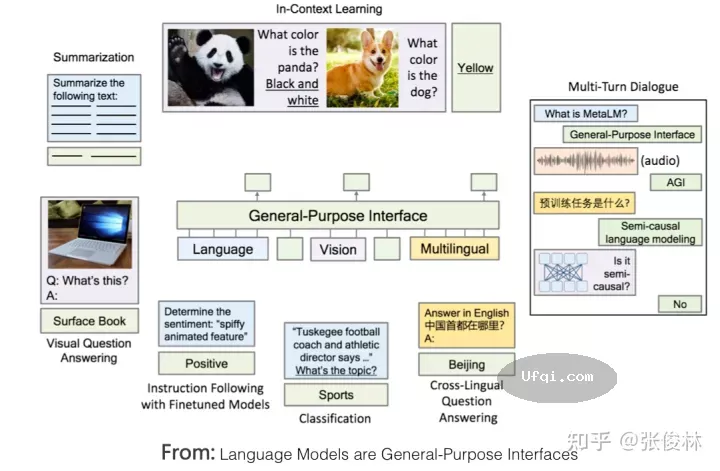

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 影响一:让LLM适配人的新型交互接口

在理想LLM的背景下,我们再来看(美国OpenAI公司的)ChatGPT,能更好理解它的技术贡献.

ChatGPT应该是目前所有的现有技术里,最接近理想LLM的技术方法.

如果归纳下ChatGPT最突出特点的话,我会用下面八个字: “能力强大,善解人意”.

“能力强大”这一点,我相信应该主要归功于ChatGPT所依托的基础LLM GPT3.5.

因为ChatGPT 尽管加入了人工标注数据,但是量级只有数万,这个规模的数据量,和训练GPT 3.5模型使用的几千亿token级别的数据量相比,包含的世界知识(数据中包含的事实与常识)可谓沧海一粟,几可忽略,基本不会对增强GPT 3.5的基础能力发挥什么作用.

所以它的强大功能,应该主要来自于隐藏在背后的GPT 3.5.

GPT 3.5对标理想LLM模型中的那个巨无霸模型.

那么,ChatGPT向GPT 3.5模型注入新知识了吗?应该是注入了,这些知识就包含在几万人工标注数据里,不过注入的不是世界知识,而是人类偏好知识.

所谓 “人类偏好”,包含几方面的含义:首先,是人类表达一个任务的习惯说法.

比如,人习惯说:“把下面句子从中文翻译成英文”,以此表达一个“机器翻译”的需求,但是LLM又不是人,它怎么会理解这句话到底是什么意思呢?你得想办法让LLM理解这句命令的含义,并正确执行.

所以,ChatGPT通过人工标注数据,向GPT 3.5注入了这类知识,方便LLM理解人的命令,这是它“善解人意”的关键.

其次,对于什么是好的回答,什么是不好的回答,人类有自己的标准,例如比较详细的回答是好的,带有歧视内容的回答是不好的,诸如此类.

这是人类自身对回答质量好坏的偏好.

人通过Reward Model反馈给LLM的数据里,包含这类 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 ⟶

02-08 06:09 , 7430 , 160 ..

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 影响一:让LLM适配人的新型交互接口

在理想LLM的背景下,我们再来看(美国OpenAI公司的)ChatGPT,能更好理解它的技术贡献.

ChatGPT应该是目前所有的现有技术里,最接近理想LLM的技术方法.

如果归纳下ChatGPT最突出特点的话,我会用下面八个字: “能力强大,善解人意”.

“能力强大”这一点,我相信应该主要归功于ChatGPT所依托的基础LLM GPT3.5.

因为ChatGPT 尽管加入了人工标注数据,但是量级只有数万,这个规模的数据量,和训练GPT 3.5模型使用的几千亿token级别的数据量相比,包含的世界知识(数据中包含的事实与常识)可谓沧海一粟,几可忽略,基本不会对增强GPT 3.5的基础能力发挥什么作用.

所以它的强大功能,应该主要来自于隐藏在背后的GPT 3.5.

GPT 3.5对标理想LLM模型中的那个巨无霸模型.

那么,ChatGPT向GPT 3.5模型注入新知识了吗?应该是注入了,这些知识就包含在几万人工标注数据里,不过注入的不是世界知识,而是人类偏好知识.

所谓 “人类偏好”,包含几方面的含义:首先,是人类表达一个任务的习惯说法.

比如,人习惯说:“把下面句子从中文翻译成英文”,以此表达一个“机器翻译”的需求,但是LLM又不是人,它怎么会理解这句话到底是什么意思呢?你得想办法让LLM理解这句命令的含义,并正确执行.

所以,ChatGPT通过人工标注数据,向GPT 3.5注入了这类知识,方便LLM理解人的命令,这是它“善解人意”的关键.

其次,对于什么是好的回答,什么是不好的回答,人类有自己的标准,例如比较详细的回答是好的,带有歧视内容的回答是不好的,诸如此类.

这是人类自身对回答质量好坏的偏好.

人通过Reward Model反馈给LLM的数据里,包含这类 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 ⟶

... 02-08 05:28 , 7428 , 136 ..

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2

潮流之巅:NLP研究范式的转换

如果我们把时间线往前拉得更长一些,回到NLP领域的深度学习时代,在更长时间窗口内观察技术变迁及其影响,可能会更容易看清其中的一些关键节点.

我个人认为,在最近10年来NLP领域的技术发展过程中,可能存在两次大的研究范型转换.

范式转换1.0:从深度学习到两阶段预训练模型

这个范式转换所涵盖的时间范围,大致在深度学习引入NLP领域(2013年左右),到GPT 3.0出现之前(2020年5月左右).

在Bert和GPT模型出现之前,NLP领域流行的技术是深度学习模型,而NLP领域的深度学习,主要依托于以下几项关键技术:以大量的改进LSTM模型及少量的改进CNN模型作为典型的特征抽取器;以Sequence to Sequence(或叫encoder-decoder亦可)+Attention作为各种具体任务典型的总体技术框架.

在这些核心技术加持下,NLP领域深度学习的主要研究目标,如果归纳一下,是如何有效增加模型层深或模型参数容量.

就是说,怎么才能往encoder和decoder里不断叠加更深的LSTM或CNN层,来达成增加层深和模型容量的目标.

这种努力,尽管确实不断增加了模型层深,但是从解决具体任务的效果角度看,总体而言,不算很成功,或者说和非深度学习方法相对,带来的优势不算大.

深度学习之所以不够成功,我认为主要原因来自于两个方面:一方面是某个具体任务有限的训练数据总量.

随着模型容量的增加,需要靠更大量的训练数据来支撑,否则即使你能把深度做起来,任务效果也做不上去.

而在预训练模型出现之前,很明显这是NLP研究领域一个严重问题;

另外一个方面是LSTM/CNN特征 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2 ⟶

迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2

潮流之巅:NLP研究范式的转换

如果我们把时间线往前拉得更长一些,回到NLP领域的深度学习时代,在更长时间窗口内观察技术变迁及其影响,可能会更容易看清其中的一些关键节点.

我个人认为,在最近10年来NLP领域的技术发展过程中,可能存在两次大的研究范型转换.

范式转换1.0:从深度学习到两阶段预训练模型

这个范式转换所涵盖的时间范围,大致在深度学习引入NLP领域(2013年左右),到GPT 3.0出现之前(2020年5月左右).

在Bert和GPT模型出现之前,NLP领域流行的技术是深度学习模型,而NLP领域的深度学习,主要依托于以下几项关键技术:以大量的改进LSTM模型及少量的改进CNN模型作为典型的特征抽取器;以Sequence to Sequence(或叫encoder-decoder亦可)+Attention作为各种具体任务典型的总体技术框架.

在这些核心技术加持下,NLP领域深度学习的主要研究目标,如果归纳一下,是如何有效增加模型层深或模型参数容量.

就是说,怎么才能往encoder和decoder里不断叠加更深的LSTM或CNN层,来达成增加层深和模型容量的目标.

这种努力,尽管确实不断增加了模型层深,但是从解决具体任务的效果角度看,总体而言,不算很成功,或者说和非深度学习方法相对,带来的优势不算大.

深度学习之所以不够成功,我认为主要原因来自于两个方面:一方面是某个具体任务有限的训练数据总量.

随着模型容量的增加,需要靠更大量的训练数据来支撑,否则即使你能把深度做起来,任务效果也做不上去.

而在预训练模型出现之前,很明显这是NLP研究领域一个严重问题;

另外一个方面是LSTM/CNN特征 ... 迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2 ⟶

本页Url

🤖 智能推荐