-

2023-04-13...Amazon CEO Jassy亚马逊电商总裁贾西年度致股东的信-2022年-2

AWS的年度营收将达到850亿美元,且仍处于早期采用阶段,但在关键时刻仍专注于长期对客户最重要的事情。2022年AWS的收入在620亿美元的基础上同比增长29%,当前宏观经济挑战令该业务面临短期阻力,因为企业客... 141 -

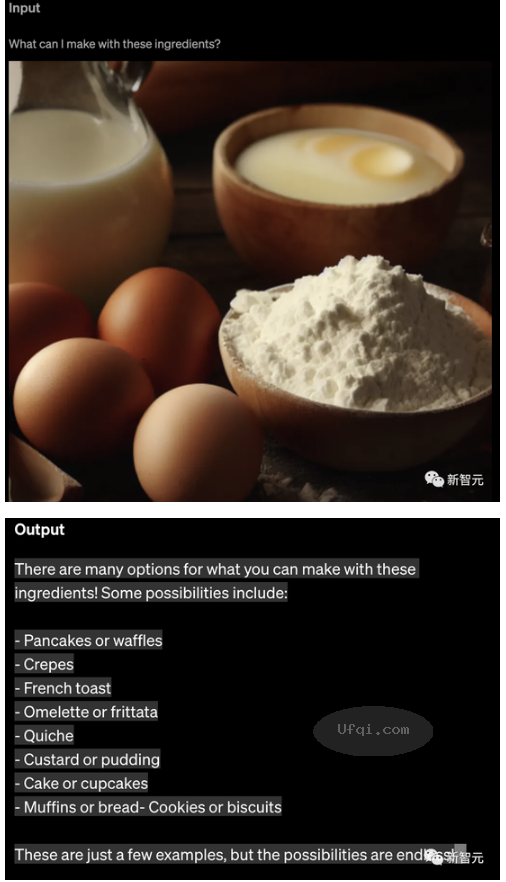

2023-03-15...[编按: 转载于 新浪网/财经头条/新智元, 2023-03-15. GPT-4王者加冕!读图做题性能炸天,凭自己就能考上斯坦福。]

美国OpenAI的ChatGPT-4发布:多模态图文混合交互

【新智元导读】Open AI的GPT-4在万众瞩目中闪亮登场,多模态功能太炸裂,简直要闪... 179 🈶🖼️ -

2023-02-20...[编按: 转载于 雪球网/松杨投资, 2023-02-17. ]

(该文来自北大校友)

我去年在西雅图微软, 而且就在负责开发 Bing 后台一部分算法的 WebXT 组, 后来因为个人原因离职了. 作为了解 ChatGPT 和新 Bing 部分内幕的底层码农, 以及 GPT-3 和... 151 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-11

取经之路:复刻ChatGPT时要注意些什么

如果希望能复刻类似ChatGPT这种效果令人惊艳的LLM模型,综合目前的各种研究结论,在做技术选型时需要重点权衡如下问题:

首先,在预训练模式上,我们有三种选择:GPT这种自回归语... 154 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10

未来之路:LLM研究趋势及值得研究的重点方向

这里列出一些我个人认为比较重要的LLM研究领域,或值得深入探索的研究方向。

探索LLM模型的规模天花板

尽管继续推大LLM模型的规模,这事看似没有技术含量,但是其实这个事... 104 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-9

代码预训练增强LLM推理能力

以上是目前利用Prompt激发LLM模型推理能力的三种主流做法,而关于LLM的推理能力,目前还观察到一个有趣且费解的现象:除了文本外,如果能够加入程序代码一起参与模型预训练,则能大幅提升LLM模型的推理能... 95 -

-

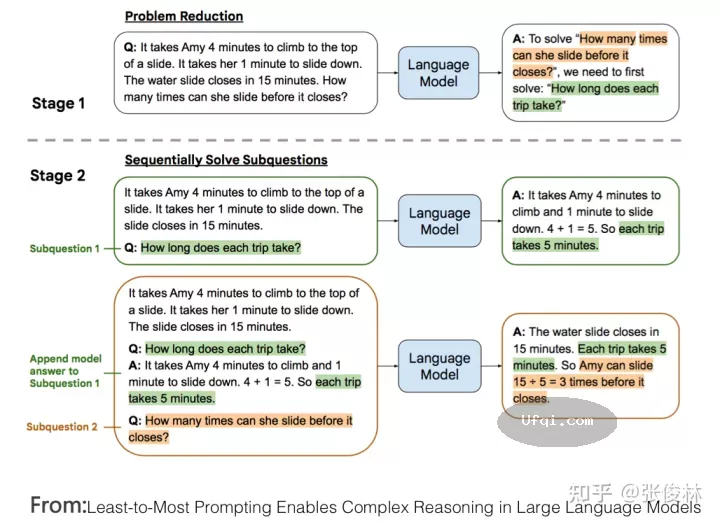

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-8

智慧之光:如何增强LLM的推理能力

目前很多研究已证明LLM对于知识具有强大的记忆能力,但是,一般我们不会因为一个人记忆能力强,就说这人很聪明,是否具有强大的推理能力,往往是我们判断一个人是否聪明的重要标准。类似的,如果LLM的效果想... 127 🈶🖼️ -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-7

人机接口:从In Context Learning到Instruct理解

一般我们经常提到的人和LLM的接口技术包括:zero shot prompting、few shot prompting、In Context Learning,以及In... 95 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-6

规模效应:当LLM越来越大时会发生什么

我们知道,近年来,LLM模型规模在快速增长,目前效果最好的LLM模型,其参数规模大都超过了千亿(100B)参数规模。比如,OpenAI的GPT 3的规模为175B,Google的LaMDA规模为... 120 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-5

学习者:从无尽数据到海量知识

从目前研究结果看,Transformer是足够强大的特征抽取器,尚不需要做特别的改进。那么通过预训练过程,Transformer学到了什么?知识是如何存取的?我们又如何修正错误知识?本节讲述这方面的研究进... 130 -

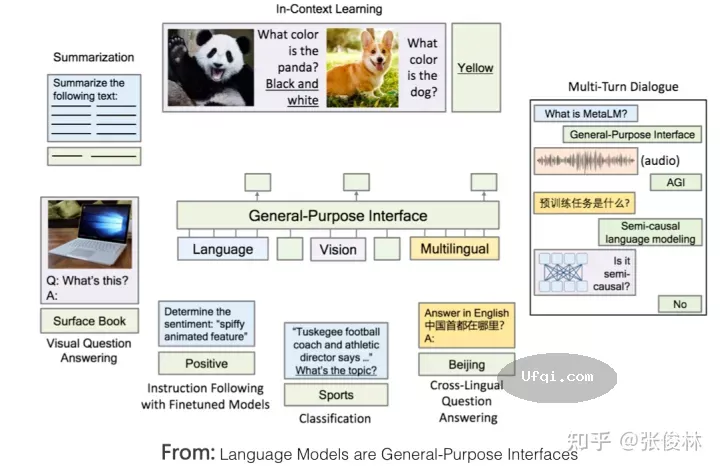

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 影响一:让LLM适配人的新型交互接口

在理想LLM的背景下,我们再来看(美国OpenAI公司的)ChatGPT,能更好理解它的技术贡献。ChatGPT应该是目前所有的现有技术里,最接近理想LLM的技术方法。如果归纳下ChatGPT最突出特点的话,我会用... 160 🈶🖼️ -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2

潮流之巅:NLP研究范式的转换

如果我们把时间线往前拉得更长一些,回到NLP领域的深度学习时代,在更长时间窗口内观察技术变迁及其影响,可能会更容易看清其中的一些关键节点。我个人认为,在最近10年来NLP领域的技术发展过程中,可能存在两次大的研究... 136 -

-

2021-08-01... [编按: 转载于 中国计算机学会通讯, 2021-07. 作者: 李国杰 院士。]

人工智能(AI)自诞生以来就众说纷纭,争议不断。近几年人工智能的高速发展也是在人们乐观与悲观情绪的交织中进行。今后几十年人工智能技术能否健康发展,取决于人们对这一 “头雁”技术的认识。

&... 168 -

2020-07-02...6. 深度学习历史进入新世纪。2004年,执着于神经网络研究的杰弗里•辛顿获得加拿大高级研究院(CIFAR)每年50万加元的经费支持,召集为数不多的同道,启动了“神经计算和自适应感知(Neural Computation and Adaptive Perception, NCAP)”项目。2006年,辛顿在《科学》发表... 163

-

2020-07-02...5. 神经网络皮茨和麦卡洛克是神经网络模型的提出者,威廉•沃尔特(William Grey Walter, 1910-1977)则是神经网络实践的先驱,他们都对控制论的创立产生了重要影响。沃尔特是一位神经生理学家,对神经连接何以产生复杂行为十分感兴趣,开发了第一台脑电图仪。与基于计算发展智能不同,沃尔特坚持用纯模拟电路... 169

-

2019-10-11...5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无... 220

-

2019-10-11...4 卷积神经网络1980年,一位法国的大学生Yann LeCun通过《Perceptron》接触到了神经元模型,这种看起来具有智慧的机器让他十分着迷,可是他发现关于神经网络的资料简直少的可怜,实际上,就像我们前面所提到的那样,在60年代已经出现的一个关于多层神经网络如何训练这个重要问题,几乎没多少人研究,更别说解决问题... 215

-

2019-10-11...3.2 受限玻尔兹曼机所谓“受限玻尔兹曼机”(RBM)就是对“玻尔兹曼机”(BM)进行简化,使玻尔兹曼机更容易更加简单使用,原本玻尔兹曼机的可见元和隐元之间是全连接的,而且隐元和隐元之间也是全连接的,这样就增加了计算量和计算难度。“受限玻尔兹曼机”(RBM)同样具有一个可见层,一个隐层,但层内无连接,层与层之间全连接,... 226

-

-

2019-10-11...1 引子在本系列的2,3,4季中,我们分别介绍了神经网络的生物学背景,最早的关于神经元的数学模型,以及具有学习功能的感知机。我们现在已经知道,如何学习神经网络的参数是最为关键的问题,这个问题从宏观上看实际上跟求解2的平方根并没有本质不同,即需要一个迭代过程(梯度下降)不断更新模型的参数。在一个著名的Adaline模型(... 218

-

2019-10-11...VC 维 由此可见,随着数据n的增长,对数据分类的能力反映了模型的性能。在之前,我们用Shattering Coefficient 即N(F,n)度量模型对数据的分类能力。实际上, 还有另一个更加著名的度量标准,VC维。此概念由Vladimir Vapnik与Alexey Chervonenkis提出。 定义: ... 190

-

2019-10-11... 引子1884年,英国著名的艺术兼神学家埃德温·A·艾勃特以科幻小说的形式,出版了一本非常有趣的小书《平面国: 一个多维的传奇故事 Flatland: A Romance of Many Dimensions》。他怎么也想不到,这本通俗有趣的小册子将成为他最为著名的著作而流芳百世,这本小说是如此的伟大,以至于必须给他挂... 183

-

-

本页Url:

-

2024-04-19-03:57 GMT . 添加到桌面浏览更方便.

-