-

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10

未来之路:LLM研究趋势及值得研究的重点方向

这里列出一些我个人认为比较重要的LLM研究领域,或值得深入探索的研究方向。

探索LLM模型的规模天花板

尽管继续推大LLM模型的规模,这事看似没有技术含量,但是其实这个事... 104 -

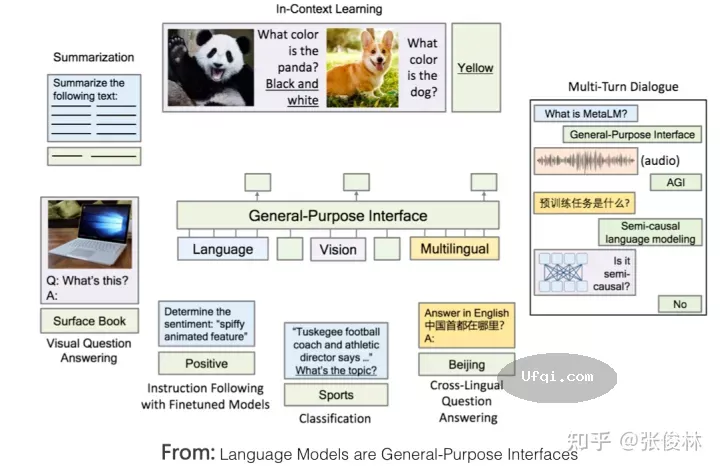

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 影响一:让LLM适配人的新型交互接口

在理想LLM的背景下,我们再来看(美国OpenAI公司的)ChatGPT,能更好理解它的技术贡献。ChatGPT应该是目前所有的现有技术里,最接近理想LLM的技术方法。如果归纳下ChatGPT最突出特点的话,我会用... 160 🈶🖼️ -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2

潮流之巅:NLP研究范式的转换

如果我们把时间线往前拉得更长一些,回到NLP领域的深度学习时代,在更长时间窗口内观察技术变迁及其影响,可能会更容易看清其中的一些关键节点。我个人认为,在最近10年来NLP领域的技术发展过程中,可能存在两次大的研究... 136 -

2022-06-06...[编按: 转载于 知乎网/田吉顺, 2015-05-10.]

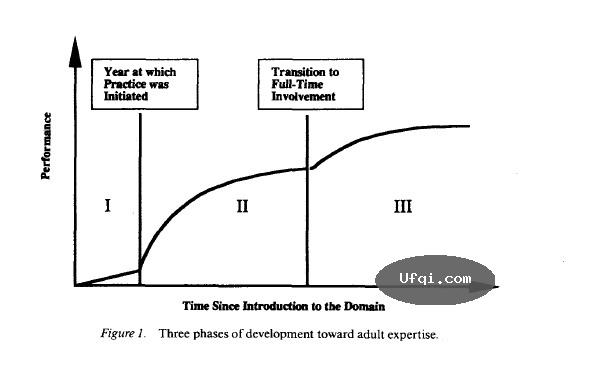

「一万小时定律」并非适合所有领域,即使有很强意志力,也很难在3到4个领域成为世界顶级。问题回答完毕,以下是解释。

「一万小时定律」怎么回事:

首先需要说明的是,这个10000不是确数,不是说你得不多不少正好1000... 165 -

2019-10-11...5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无... 220

-

2019-10-11...4 卷积神经网络1980年,一位法国的大学生Yann LeCun通过《Perceptron》接触到了神经元模型,这种看起来具有智慧的机器让他十分着迷,可是他发现关于神经网络的资料简直少的可怜,实际上,就像我们前面所提到的那样,在60年代已经出现的一个关于多层神经网络如何训练这个重要问题,几乎没多少人研究,更别说解决问题... 215

-

-

2019-10-11...1 引子在本系列的2,3,4季中,我们分别介绍了神经网络的生物学背景,最早的关于神经元的数学模型,以及具有学习功能的感知机。我们现在已经知道,如何学习神经网络的参数是最为关键的问题,这个问题从宏观上看实际上跟求解2的平方根并没有本质不同,即需要一个迭代过程(梯度下降)不断更新模型的参数。在一个著名的Adaline模型(... 218

-

-

本页Url:

-

2024-04-25-09:57 GMT . 添加到桌面浏览更方便.

-