-

2024-04-04...阿里巴巴联合创始人蔡崇信博客访谈2024-3

那么,你是如何纠正的?你采取了什么样的措施?

我们做的第一件事就是承认错误,我们承认过去我们可能没有关注用户体验。第二件事就是对我们的人员进行改组,改变符合战略的组织架构。我认为这是大公司非常普遍的问题。大公司的组织结构是固定的,然后他们... 60 -

2023-12-31...财经作家吴晓波跨年演讲:定力至上2024年-9 接着来到了7月,Facebook的母公司META发布700亿参数规模的开源大模型基座Llama2;Android版的ChatGPT在美国、印度、巴西等国家推出;京东推出了它的“言犀大模型”。7月,我在全球文献上看到了两个产品。第一个和“作弊”有关。斯坦福大学的创业者发明... 117

-

2023-12-05...真正的創業投資高手都是贝叶斯主义者-2

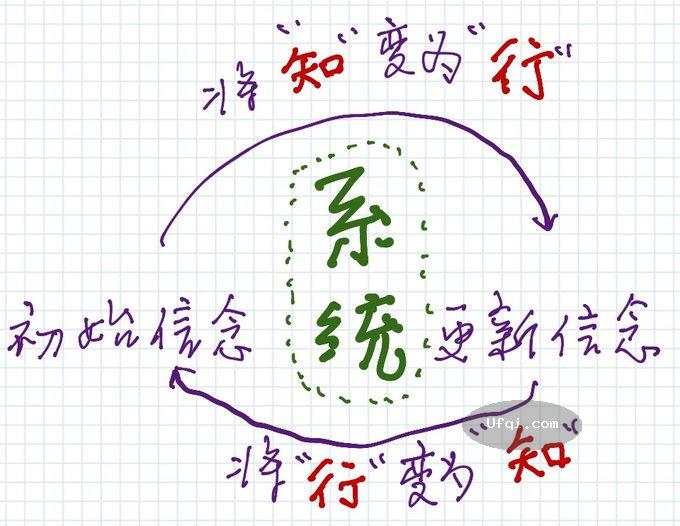

二、快速行动和迭代,打造 “知行一体”的反馈飞轮 贝叶斯思想强调快速迭代、快速行动。只有通过实践,我们才能得到反馈,从而不断学习和进步。 我们总是说“知行合一”,但这个词到底啥意思呢?

知行合一,简称... 127 🈶🖼️ -

2023-06-11...2023中国经济传媒大会媒体论坛文字实录-6 (21世纪经济报道执行总编辑)陈晨星: 刚才(主持人)灿国老师讲到,我们的组织架构是不是发生了比较大的变化?是的,发生了非常大的变化。我们所有工作,尤其是采编,包括视频制作、创意团队、设计团队,是7×24小时的工作方式,几乎所有的内容都是在移动端上完成的。

&nb... 141 -

2023-06-11...2023中国经济传媒大会媒体论坛文字实录-4 第三个PK是大模型和传统编采,AIGC发展对传统媒体的影响。这种影响,我大概把它梳理了一下,这里不多讲。从2022年11月,它的逻辑线是从ChatGPT3.5一直到现在4.0,包括国内的诸多大模型,相当于一个科普,大家应该非常清楚。但是产生的影响是巨大的。我自... 146

-

2023-02-20...[编按: 转载于 雪球网/松杨投资, 2023-02-17. ]

(该文来自北大校友)

我去年在西雅图微软, 而且就在负责开发 Bing 后台一部分算法的 WebXT 组, 后来因为个人原因离职了. 作为了解 ChatGPT 和新 Bing 部分内幕的底层码农, 以及 GPT-3 和... 151 -

-

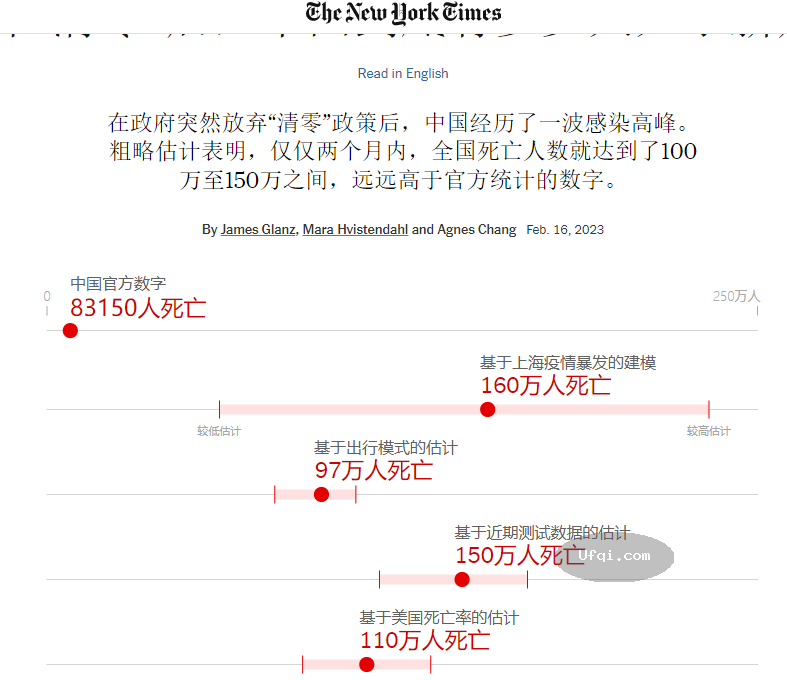

2023-02-17... [编按: 原发于 纽约时报中文网/James Glanz, Mara Hvistendahl and Agnes Chang, 2023-02-16. ] 在政府突然放弃“(新冠肺炎疫情动态)清零”政策后,中国经历了一波感染高峰。粗略估计表明,仅仅两个月内,全国死亡人数就达到了100... 134 🈶🖼️

-

2023-02-10...[编按: 转载于 网易网/蒲公英互联, 2023-02-10. ]

ChatGPT 编年史

我们如何错过GPT盛宴

GPT大语言模型能实现AGI吗?

----

ChatGPT编年史----

我们来梳理一个时间轴。ChatGPT是对话式UI + GPT–... 164 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-11

取经之路:复刻ChatGPT时要注意些什么

如果希望能复刻类似ChatGPT这种效果令人惊艳的LLM模型,综合目前的各种研究结论,在做技术选型时需要重点权衡如下问题:

首先,在预训练模式上,我们有三种选择:GPT这种自回归语... 154 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-10

未来之路:LLM研究趋势及值得研究的重点方向

这里列出一些我个人认为比较重要的LLM研究领域,或值得深入探索的研究方向。

探索LLM模型的规模天花板

尽管继续推大LLM模型的规模,这事看似没有技术含量,但是其实这个事... 104 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-9

代码预训练增强LLM推理能力

以上是目前利用Prompt激发LLM模型推理能力的三种主流做法,而关于LLM的推理能力,目前还观察到一个有趣且费解的现象:除了文本外,如果能够加入程序代码一起参与模型预训练,则能大幅提升LLM模型的推理能... 95 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-7

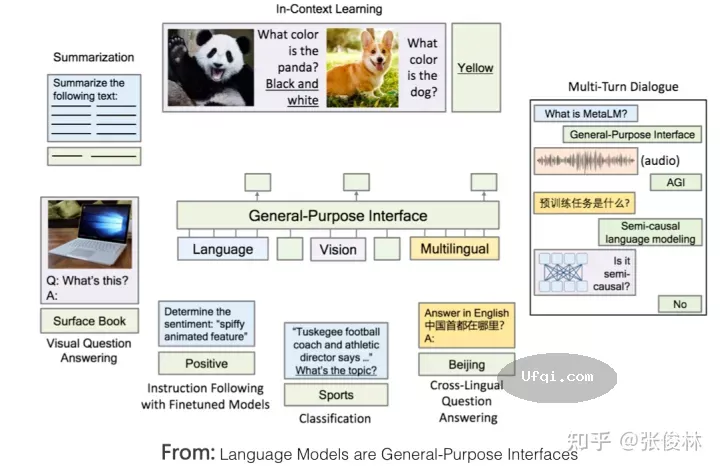

人机接口:从In Context Learning到Instruct理解

一般我们经常提到的人和LLM的接口技术包括:zero shot prompting、few shot prompting、In Context Learning,以及In... 95 -

-

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-5

学习者:从无尽数据到海量知识

从目前研究结果看,Transformer是足够强大的特征抽取器,尚不需要做特别的改进。那么通过预训练过程,Transformer学到了什么?知识是如何存取的?我们又如何修正错误知识?本节讲述这方面的研究进... 130 -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-4 影响一:让LLM适配人的新型交互接口

在理想LLM的背景下,我们再来看(美国OpenAI公司的)ChatGPT,能更好理解它的技术贡献。ChatGPT应该是目前所有的现有技术里,最接近理想LLM的技术方法。如果归纳下ChatGPT最突出特点的话,我会用... 160 🈶🖼️ -

2023-02-08...迈向通用人工智能AGI之路:大型语言模型LLM技术精要-2

潮流之巅:NLP研究范式的转换

如果我们把时间线往前拉得更长一些,回到NLP领域的深度学习时代,在更长时间窗口内观察技术变迁及其影响,可能会更容易看清其中的一些关键节点。我个人认为,在最近10年来NLP领域的技术发展过程中,可能存在两次大的研究... 136 -

2022-10-31...商业进化的力量-2022-把确定性传递给每一个人-2

弹性

找到2023的确定性的第一步,就是:化解意外。可是,如何化解?

我们先从一个故事开始。

如果我说,2021年,俞敏洪遭遇了常人难以想象的 “意外”,可能不会有人反对。新东方在教培行业,构建... 132 -

2021-11-11...第二个主题是我在 1979 年提出的通信复杂性。

让我先解释一下这个数学问题,爱丽丝和鲍勃是两个在不同地点的人,他们各自持有一条 n 个比特的数据,比如 x 和 y。我们想要解决的问题是,假设它们想要联合计算某个量 f,它们之间需要通信多少比特,这就是这个函数的通信复杂度。

当然,这取决于你在计算什么函... 100 -

2021-04-14...rust 是一门非常优秀的语言,我虽然没有特别正式介绍过 rust 本身,但其实已经写了好多篇跟 rust 相关的文章:

沅有芷兮:类型系统的数学之美

Noise 协议的应用

用 noise 协议的思路来点对点加密文件?

如何安全地保存密码?

从微秒到纳秒:关于性能的奇妙旅程

2020-07-02...6. 深度学习历史进入新世纪。2004年,执着于神经网络研究的杰弗里•辛顿获得加拿大高级研究院(CIFAR)每年50万加元的经费支持,召集为数不多的同道,启动了“神经计算和自适应感知(Neural Computation and Adaptive Perception, NCAP)”项目。2006年,辛顿在《科学》发表... 1632019-10-11...5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无... 2202019-10-11...3.2 受限玻尔兹曼机所谓“受限玻尔兹曼机”(RBM)就是对“玻尔兹曼机”(BM)进行简化,使玻尔兹曼机更容易更加简单使用,原本玻尔兹曼机的可见元和隐元之间是全连接的,而且隐元和隐元之间也是全连接的,这样就增加了计算量和计算难度。“受限玻尔兹曼机”(RBM)同样具有一个可见层,一个隐层,但层内无连接,层与层之间全连接,... 2262019-10-11...VC 维 由此可见,随着数据n的增长,对数据分类的能力反映了模型的性能。在之前,我们用Shattering Coefficient 即N(F,n)度量模型对数据的分类能力。实际上, 还有另一个更加著名的度量标准,VC维。此概念由Vladimir Vapnik与Alexey Chervonenkis提出。 定义: ... 190

2020-07-02...6. 深度学习历史进入新世纪。2004年,执着于神经网络研究的杰弗里•辛顿获得加拿大高级研究院(CIFAR)每年50万加元的经费支持,召集为数不多的同道,启动了“神经计算和自适应感知(Neural Computation and Adaptive Perception, NCAP)”项目。2006年,辛顿在《科学》发表... 1632019-10-11...5 循环神经网络循环神经网络也被称为时间递归神经网络(Recurrent neural network)在前面讨论的卷积神经网络,无法利用历史数据的时间依赖关系,来分析数据特征,对于二维图像来讲,我们已经知道局部感受视野这种空间信息是识别问题的核心,在另外一些与时间相关的问题中,输入的数据是基于时间的序列,卷积网络就无... 2202019-10-11...3.2 受限玻尔兹曼机所谓“受限玻尔兹曼机”(RBM)就是对“玻尔兹曼机”(BM)进行简化,使玻尔兹曼机更容易更加简单使用,原本玻尔兹曼机的可见元和隐元之间是全连接的,而且隐元和隐元之间也是全连接的,这样就增加了计算量和计算难度。“受限玻尔兹曼机”(RBM)同样具有一个可见层,一个隐层,但层内无连接,层与层之间全连接,... 2262019-10-11...VC 维 由此可见,随着数据n的增长,对数据分类的能力反映了模型的性能。在之前,我们用Shattering Coefficient 即N(F,n)度量模型对数据的分类能力。实际上, 还有另一个更加著名的度量标准,VC维。此概念由Vladimir Vapnik与Alexey Chervonenkis提出。 定义: ... 190

-

本页Url:

-

2024-04-19-23:34 GMT . 添加到桌面浏览更方便.

-