-

05-20 06:40...GPT-4o在英文文本和代码处理上与此前最新的GPT-4Turbo的性能不相上下,但在非英文文本、视觉和音频理解方面都更为高效。此前,若使用语音模式对话,GPT-3.5的平均延迟为2.8秒,GPT-4则为5.4秒。人类的平均反应时间一般为100毫秒到400毫秒,而GPT-4o最低可达232毫秒,因此后者可以提供几乎无延... 0

-

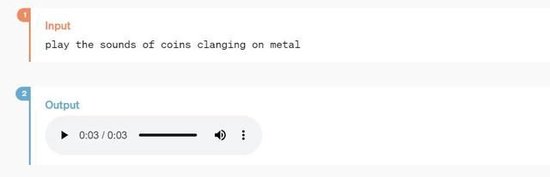

05-16 20:10...它可以实时对音频、视觉和文本进行接收、推理,并生成文本、音频和图像的任意组合输出。该模型与过往版本比较,省去了将用户的声音转化为文本并处理的步骤,意味着整个流程更加快速。GPT-4o还缩短了模型处理特定数量token所需的时间(在英语文本的情况下,一个token通常等于一个半单词),这也使得该模型比OpenAI此前最佳... 0

-

05-16 19:20...实时聊天是ChatGPT的关键技能。相比先前版本,GPT-4o的不同主要表现在:一是使用者可以随时打断聊天机器人,无需像从前那样等它把话说完;二是它会实时对问题作出回应,不再有两到三秒的时滞;三是它能感知人的情绪,比如演示者呼吸急促,它会询问对方是否需要稍稍稳定下情绪。另外,GPT-4o可以生成不同风格的声音。演示中,... 0

-

05-15 23:00...还能解答数学方程式,甚至还能识别图像中的人物微表情。根据传统基准测试,GPT-4o的性能对比GPT-4Turbo(OpenAI去年11月发布的大模型)基本都处于优势,对比其他模型更是大幅领先。具体来说,GPT-4o在英语文本和代码上的性能与GPT-4Turbo类似,但在非英语文本上的性能显著提高,与现有模型相比,GPT... 0

-

05-15 06:20...它反应迅速,语调流畅自然,情绪饱满,会跟随着你的情绪兴奋起来,也能根据上下文给出丰富的对话细节,揣摩对话者的情绪。例如,当OpenAI的研发负责人MarkChen上台时,他对着GPT-4o说:“我站在台上有点紧张,该怎么办?”GPT-4o回答:“你太棒了,深呼吸一下吧,记得你可是个专家。”MarkChen随之大声喘气,... 0

-

05-15 04:00...“GPT-4o可以综合利用语音、文本和视觉信息进行推理,”穆拉蒂在OpenAI公司总部举行的主题演讲中表示。GPT-4是OpenAI此前的旗舰模型,可以处理由图像和文本混合而成的信息,并能完成诸如从图像中提取文字或描述图像内容等任务,GPT-4o则在此基础上新增了语音处理能力。GPT-4o的运行速度将大大提升,最大亮点... 0

-

-

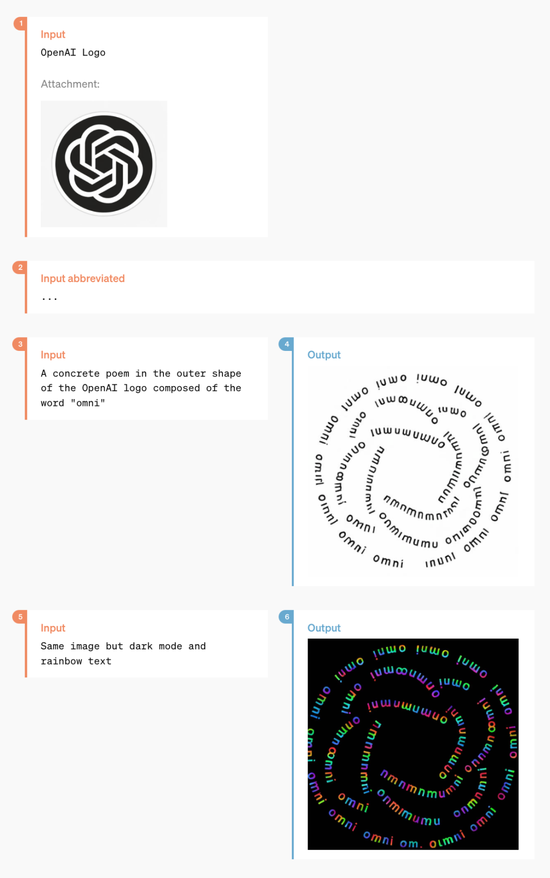

05-15 04:00...GPT-4o能够接受文本、音频和图像的任意组合作为输入,并生成文本、音频和图像的任意组合输出,是兼具了“听觉”、“视觉”的多模态模型。对于这项能力,OpenAI做了17个案例展示,其中包括照片转漫画、3D物体合成、海报创作、角色设计等样本。在角色设计案例里,用户向模型输入角色的相关指令,就可以得到一个机器人角色形象。其... 0

-

05-14 03:40...实时求解方程、做口译、分析图表、读取用户情绪GPT-4之前已经可以分析图像和文本,完成从图像中提取文本、以文本描述图像内容这类任务。GPT-4o则是增加了语音功能。Murati强调了GPT-4o在实时语音和音频功能方面必要的安全性,称OpenAI将继续部署迭代,带来所有的功能。在演示中,OpenAI研究主管MarkCh... 0

-

05-14 03:40...OpenAI已经找到了一种方法,可以直接将音频映射到音频作为第一类模态,并实时将视频流传输到transformer大模型。这需要对标记化和架构进行一些新的研究,但总体上是一个数据和系统优化问题。高质量的数据至少可以来自以下两个来源:首先是YouTube、播客、电视剧、电影等内容包含的对话。可以训练Whisper来识别对... 0

-

05-14 03:40...SamAltman所说的“原生多模态”指的是融合了文本、图像和语音功能。他还发帖称,希望尝试使用GPT-4o的开发者将可以获得API,从周一开始就可以使用该新模型构建应用,其价格为GPT-4Turbo的一半,但速度可以达到后者的两倍。此外,GPT-4o在处理英语文本和编程代码方面达到了GPT-4Turbo的性能水平,对... 0

-

05-14 03:30...ChatGPT识别到OpenAI后训练团队负责人巴雷特·佐夫(BarretZoph)脸上的微笑,对他说:“你脸上挂着灿烂的笑容,看起来心情很好。”但GPT-4o在演示过程中也出现一些失误。例如,它在尚未读取到图像时就开始求解方程,还一度把佐夫的面部识别为“木质表面”。英国广播公司(BBC)称,这表明生成式人工智能的“幻... 0

-

05-14 03:10...完全没有AI的机械感和僵硬感!相比反应迟钝、没法打断还缺少情商的Siri等语音助手,这局ChatGPT完胜。这,才是人类最理想AI语音助手的样子啊,Moss果然成真了!不仅如此,ChatGPT的「高情商」也让观众们惊呼太顶了!对话中,它可以听懂用户说话时不同的语调、语气,还能根据自己的台词生成不同语气的语音,完全没有「... 0

-

-

05-14 03:00...平均为320毫秒,这与人类在谈话中的反应时间,基本一致。此外,GPT-4o在英语文本和代码上的性能与GPT-4Turbo的性能相匹配,在非英语文本上的性能显着提高,同时API的速度也更快,成本降低了50%,速度是GPT-4-turbo的两倍。与现有模型相比,GPT-4o在视觉和音频理解方面尤其出色。2、全能立体,沟通无... 0

-

05-14 02:30...让ChatGPT以一句话的方式回应所有有关此图的问题。最热的月份在几月,Y轴是摄氏度还是华氏度,它都能回答得上来。OpenAI还回应了一些上网友们实时提出的问题。比如实时语音翻译,手机可以拿来当翻译机来回翻译西班牙语和英语。又有人问道,ChatGPT能识别你的表情吗?看起来,GPT-4o已经能够做到实时的视频理解了。接... 0

-

05-14 02:30...才是人类最理想AI语音助手的样子啊,Moss果然成真了!不仅如此,ChatGPT的‘高情商’也让观众们惊呼太顶了!对话中,它可以听懂用户说话时不同的语调、语气,还能根据自己的台词生成不同语气的语音,完全没有‘机械感’。扮演不同角色,给任性的人类讲睡前故事接下来,ChatGPT被要求讲一个睡前故事,主题是‘恋爱中的’。C... 0

-

05-14 02:20...穆拉蒂在OpenAI春季更新发布会上介绍GPT-4o在发布会现场演示中,GPT-4o可以像人工智能助手一样,实现用户与ChatGPT的实时交互,不再是一问一答,也不需要其他按键操作。比如,用户可以说“Hi,ChatGPT”并提出问题,也可以在ChatGPT回答时打断它,它还可以识别用户声音中展现的情感,甚至实时根据用户... 0

-

05-14 02:20...GPT-4o有着更快的反应速度:它可以在232毫秒的时间内响应音频输入,平均为320毫秒,这与人类在谈话中的反应时间,基本一致。此外,GPT-4o在英语文本和代码上的性能与GPT-4Turbo的性能相匹配,在非英语文本上的性能显着提高,同时API的速度也更快,成本降低了50%,速度是GPT-4-turbo的两倍。与现有... 0

-

05-07 10:20...5对长文本的理解、学习、回答能力,科大讯飞进行了重要的模型剪枝和蒸馏,从而推出业界性能最优的130亿参数的大模型,在效果损失仅3%以内的情况下,使得星火在文档上传解析处理、知识问答的首响时间以及文字生成方面都获得了极大的效率提升。测试显示,在保障长文本效果的情况下,无论是10K、64K、128Ktoken,还是更长的文... 0

-

-

05-05 20:40...可实现文本转化成语音的功能。殷某将5家公司诉至法院称,其曾接受被告二北京某文化传媒公司的委托录制录音制品,被告二为录音制品的著作权人。后被告二将原告为其录制的录音制品的音频提供给被告三某软件公司,允许被告三以商业或非商业的用途使用、复制、修改数据用于其产品及服务。被告三以原告录制的录音制品作为素材进行AI化处理,生成了... 2

-

04-30 19:00...还能够在各种行业场景中给出专业、准确回答。为什么科大讯飞要推出长文本、长图文、长语音的大模型?科大讯飞董事长刘庆峰介绍,通过讯飞星火APP收集到的用户数据,大部分用户在知识获取和学习的过程中,拿到的资料往往是报刊书籍等长文本,还有各种会议的PPT、笔记、录音和视频等。能不能把这些文本、图片、语音等都上传到讯飞星火中,快... 0

-

04-29 14:40...科大讯飞董事长刘庆峰谈道,基于讯飞星火V3.5对长文本的理解、学习、回答能力,科大讯飞进行了重要的模型剪枝和蒸馏,从而推出业界性能最优的130亿参数的大模型,在效果损失仅3%以内的情况下,使得星火在文档上传解析处理、知识问答的首响时间以及文字生成方面都获得了极大的效率提升。测试显示,在保障长文本效果的情况下,无论是10... 0

-

04-25 08:50...经声音筛选和溯源,发现上述作品中的声音来自于被告一北京某智能科技公司运营的平台中的文本转语音产品,用户通过输入文本、调整参数,可实现文本转化成语音的功能。原告曾接受被告二北京某文化传媒公司的委托录制录音制品,被告二为录音制品的著作权人。后被告二将原告为其录制的录音制品的音频提供给被告三某软件公司,允许被告三以商业或非商... 0

-

-

-

本页Url:

-

2024-05-20-17:32 GMT . 添加到桌面浏览更方便.

-